ليس خطأً تقنيًا فقط.. حين يصبح الانحراف البرمجي أيديولوجيا مستترةً

AI بالعربي – متابعات

مقدمة

حين نسمع عن “أخطاء برمجية”، يتبادر إلى أذهاننا صورة بسيطة: خلل تقني يمكن إصلاحه بتحديث سريع. لكن في عصر الذكاء الاصطناعي، لم يعد الانحراف البرمجي مجرد خطأ عابر، بل قد يتحول إلى أيديولوجيا مستترة تُعاد صياغتها داخل الشيفرات والخوارزميات، لتؤثر في وعي المستخدمين وتوجهاتهم.

فالبرمجيات اليوم لم تعد مجرد أدوات حسابية، بل أنظمة تُشكّل الرأي العام، تصوغ الأخبار، وتقترح ما يجب أن نقرأ أو نشتري أو نفكر فيه. وحين تتسرب تحيزات مصمميها أو قيود بيئتها إلى صميمها، يصبح “الخطأ التقني” نافذة لأجندة غير معلنة.

الانحراف البرمجي: من عطل تقني إلى تحيز منهجي

-

في الماضي، كان الخطأ البرمجي Bug يعني توقف التطبيق عن العمل أو ظهور نتيجة غير متوقعة.

-

أما اليوم، فالانحراف البرمجي قد يكون خوارزمية توصية تُبرز محتوى بعينه أو نظام تصنيف يُقصي فئة معينة.

-

هذا الانحراف ليس مجرد خلل في الكود، بل انعكاس لرؤية مصمم أو شركة، ما يجعله أقرب إلى موقف أيديولوجي مضمّن.

كيف يتحول الكود إلى أيديولوجيا؟

-

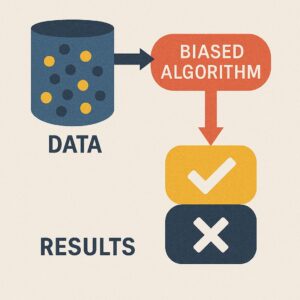

اختيار البيانات: إذا كانت البيانات متحيزة (جندرية، عرقية، سياسية)، فالنتائج ستُكرّس نفس التحيز.

-

الأهداف التجارية: إذا كان الهدف هو تعظيم الأرباح، فقد تُعطي الخوارزميات الأولوية لمحتوى مثير للجدل على حساب الدقة.

-

المعايير الثقافية: مطوّر يعيش في بيئة معينة قد يضع افتراضات تعكس ثقافته الخاصة.

-

آلية التصفية: حين تقرر الخوارزميات ما يستحق الظهور أو الاختفاء، فهي تمارس دورًا شبيهًا بالرقابة.

أمثلة واقعية

-

وسائل التواصل: دراسات كشفت أن بعض الخوارزميات تعطي أولوية للمحتوى العاطفي أو الغاضب لأنه يزيد التفاعل، حتى لو كان مضللًا.

-

الترجمة الآلية: نماذج لغوية افترضت أن الطبيب رجل والممرضة امرأة، ما يعكس تحيزًا اجتماعيًا.

-

التوظيف: أنظمة فرز السير الذاتية استبعدت بشكل غير مباشر النساء بسبب بيانات تدريب متحيزة تاريخيًا.

-

الأخبار: خوارزميات بعض المنصات رتبت الأخبار بطريقة عززت خطابًا سياسيًا دون آخر.

لماذا الأمر أخطر من مجرد “خطأ”؟

-

الانتشار الصامت: ملايين المستخدمين يتأثرون دون أن يدركوا.

-

الشرعية التقنية: عندما يأتي التوجيه من “آلة”، يبدو أكثر حيادية وموثوقية.

-

التأثير طويل المدى: الانحراف المستمر يعيد تشكيل الوعي الجمعي.

-

تضخيم الفوارق: الانحرافات الصغيرة المتكررة تتحول إلى أنماط هيكلية عميقة.

لوحة بيانية توضح مسار التحيز من البيانات إلى النتائج

خوارزميات توصية تتحكم في ترتيب الأخبار على الشاشات

رمزية لفقدان الحياد في الذكاء الاصطناعي

التحديات الأخلاقية والسياسية

-

المسؤولية: من يُحاسب على الانحراف؟ الشركة؟ المبرمج؟ أم الخوارزمية نفسها؟

-

الشفافية: كثير من الشركات لا تكشف عن كيفية عمل أنظمتها.

-

الثقة: حين يكتشف المستخدم أن الأداة منحازة، يفقد الثقة في التقنية كلها.

-

التنظيم: الحاجة لتشريعات تضمن ألا تتحول الخوارزميات إلى أدوات للتلاعب الأيديولوجي.

كيف نواجه “الأيديولوجيا المستترة”؟

-

إلزام الشركات بالشفافية: الكشف عن معايير التصفية والتوصية.

-

مراجعة مستقلة: مؤسسات محايدة تختبر الخوارزميات بشكل دوري.

-

تنويع فرق التطوير: إشراك ثقافات وخلفيات مختلفة لتقليل التحيز.

-

تربية رقمية: وعي المستخدم بأن المحتوى الذي يراه ليس محايدًا بالكامل.

س: ما الفرق بين الخطأ البرمجي والانحراف الأيديولوجي؟

ج: الخطأ البرمجي خلل تقني يُصلح، أما الانحراف الأيديولوجي فيُعيد إنتاج تحيزات مضمّنة في النظام.

س: كيف تنشأ الأيديولوجيا داخل الخوارزميات؟

ج: عبر اختيار البيانات، أهداف الشركات، والمعايير الثقافية للمبرمجين.

س: لماذا يعد الأمر خطيرًا؟

ج: لأنه يؤثر على الملايين بشكل غير مرئي، ويعيد تشكيل الوعي الجمعي.

س: كيف نواجه هذه المشكلة؟

ج: بالشفافية، المراجعة المستقلة، تنويع فرق التطوير، وتربية المستخدمين رقميًا.

الخلاصة

لم يعد الانحراف البرمجي مجرد خطأ تقني، بل قد يكون أيديولوجيا مستترة تعيد صياغة وعينا الجمعي دون أن نشعر. حين تُصبح الخوارزميات مرآةً لتحيزات المصممين والشركات، فإنها تتحول من أداة تقنية إلى قوة سياسية وثقافية صامتة. التحدي الأكبر هو كشف هذا المستتر، وبناء أنظمة تحترم التنوع والعدالة والشفافية.

اقرأ أيضًا: من يُنتج مَن؟.. تلاشي الحدود بين المستخدم والأداة

Beta feature