AI بالعربي – متابعات

بصورة مستمرة، تعمل نقاشات الذكاء الاصطناعي Artificial Intelligence التي تدور في الحلقات السياسية، على وضع الصين في مواجهة الولايات المتحدة ضمن سباق محموم على التفوق التكنولوجي. وإذا افترض أن البيانات تشكل الميزة الأساسية للتقدم، فسيكون الفوز من نصيب الصين التي تحتضن أكثر من مليار مواطن، وتتراخى فيها ضمانات الحماية من رقابة الدولة. ووفق عالم الكومبيوتر الشهير كاي – فو لي، تمثل البيانات النفط الجديد، والصين “أوبك” الجديدة. في المقابل، إذا جاءت الأفضلية من طريق التكنولوجيا المتفوقة، فستكون للولايات المتحدة، مع ما تملكه من نظام جامعي عالمي وقوة عاملة موهوبة، فرصة كسب السباق. وفي البلدين كليهما، يفترض المهتمون بأن التفوق في الذكاء الاصطناعي يترجم إلى تفوق اقتصادي وعسكري.

في المقابل، يغفل التفكير في الذكاء الاصطناعي من زاوية السباق على الهيمنة، التفكير في أهم الطرق التي يغير بها الذكاء الاصطناعي ملامح السياسة العالمية. فمع مرور الزمن، لن يغير الذكاء الاصطناعي مفهوم التنافس بين القوى بقدر ما سيغير المتنافسين أنفسهم، بمعنى أن تعلّم الآلات [أي أن تتعلّم الآلات التفكير على طريقة البشر بفضل الذكاء الاصطناعي] الآلي سيفرض تحديات على الأنظمة السياسية وسيؤثر في ديمقراطية الولايات المتحدة وديكتاتورية الصين، وإن بطرق متباينة. وبالنسبة إلى التحديات التي سيفرضها تعلّم الآلات على الديمقراطيات كتلك الموجودة في واشنطن، فإنها تبدو واضحة للغاية، إذ قد يسهم تعلّم الآلات في زيادة حدة الاستقطاب السياسي، كأن يعيد هندسة عالم الإنترنت بطرق تعمق الانقسامات السياسية. وكذلك سيزيد المعلومات المضللة التي قد تنتج عنها خطابات مزيفة ومقنعة تنتشر على مدى واسع. أما بالنسبة إلى التحديات التي سيرميها تعلّم الآلات في وجه الأنظمة الأوتوقراطية [يسمى نظام الحكم المطلق لفرد واحد، بالنظام الأوتوقراطي]، فإنها أقل حدة لكنها قد تكون أكثر تقويضاً على الأرجح. وعلى غرار ما يفعله تعلّم الآلات من تسليط الضوء على الانقسامات في الديمقراطية ويعمقها، فإنه سيبلبل أحوال الأنظمة الأوتوقراطية فيعطي صورة زائفة عن إجماع يخفي الانقسامات المجتمعية الأساسية حتى فوات الأوان.

وقد أدرك الرواد الأوائل للذكاء الاصطناعي، وفي مقدمتهم العالم السياسي هربرت سيمون، أن تكنولوجيا الذكاء الاصطناعي أقرب إلى الأسواق والبيروقراطيات والمؤسسات السياسية منه إلى التطبيقات الهندسية البسيطة. وفي المقابل، رأى فيه نوربرت فينر، وهو رائد آخر في الذكاء الاصطناعي، نظاماً “سيبرانياً” يمكنه الاستجابة والتكيف مع التعليقات والملاحظات، لكن أياً منهما لم يتوقع الطريقة التي سيسود فيها تعلّم الآلات في عالم الذكاء الاصطناعي، مع العلم أن ما شهدته وتشهده تلك التقنية من تطورات يتناسب تماماً مع طريقة تفكيرهما. وفي الوقت الحاضر، يستخدم “فيسبوك” و”غوغل” تقنية تعلّم الآلات بوصفها محركاً تحليلياً لنظام يصحح نفسه ذاتياً، إذ يحدث فهمه للبيانات بشكل مستمر في ضوء نجاح تنبؤاته أو فشلها، بالتالي فقد عملت هذه الحلقة التي تصل بين التحليل الإحصائي وردود فعل منظومة الذكاء الاصطناعي، على جعل تعلّم الآلات قوة يحسب لها ألف حساب.

ومن المفهوم بشكل أقل أن الديمقراطية والسلطوية هما نظامان سيبرانيان أيضاً. ففي ظلهما، تبلور الحكومات السياسات وتصنعها وتطورها وتقييم نجاحها أو فشلها، إذ تعول الديمقراطيات على الآراء والأصوات للحصول على ردود فعل قوية في شأن هذا النهج السياسي أو ذاك. وتاريخياً، وجدت الديكتاتوريات صعوبة كبيرة في الحصول على ردود فعل إيجابية. وحتى قبل عصر المعلومات، اعتمدت الديكتاتوريات على الاستخبارات المحلية والعرائض واستطلاعات الرأي السرية، لمعرفة ما يشعر به المواطنون إزاء سياساتها.

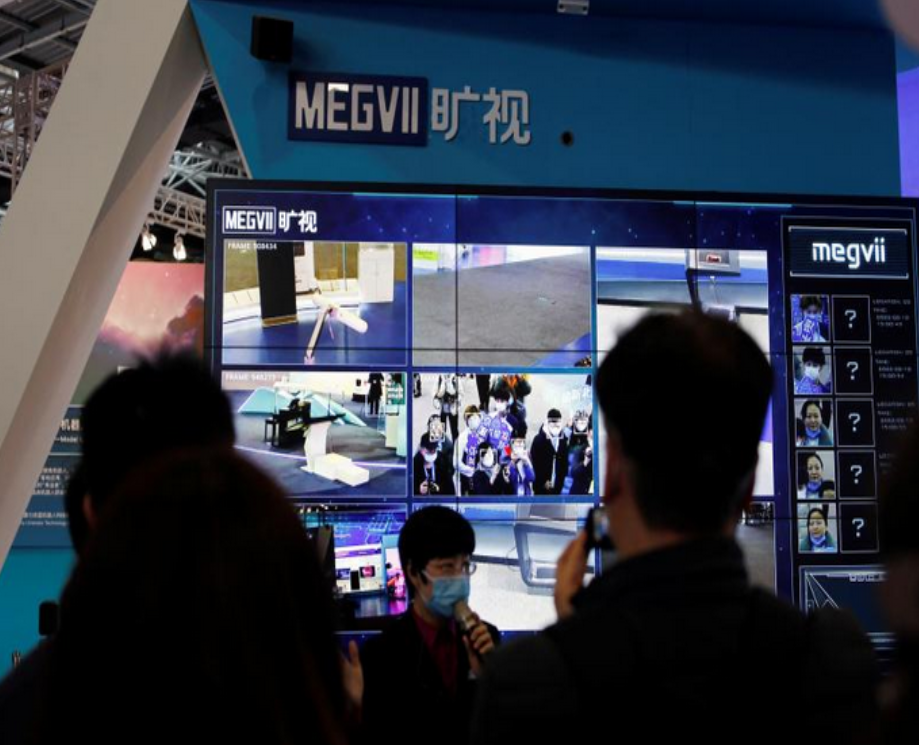

وفي ظل التكنولوجيات الحديثة التي تيسر انتشار المعلومات المضللة وتفاقم أوجه التمييز السائدة، من طريق تحويل التحيزات المعرفية المخبأة في ثنايا البيانات إلى تأكيدات خاطئة، بات تعلّم الآلات يعمل على تعطيل أشكال الملاحظات المعتمدة تقليدياً من قبل الديمقراطيين (الآراء والأصوات)، لكن يسير الأمر على نحو معاكس تماماً بالنسبة إلى الأوتوقراطيين الذين يتخبطون في الظلام. لماذا؟ لأن تلك تكنولوجيا تطلع الحكام على آراء رعاياهم من دون تكبد مشقة الاستطلاعات أو المخاطر السياسية للمناقشات المفتوحة والانتخابات. ولعل هذا هو السبب الفعلي وراء إعراب عديد من المراقبين عن قلقهم الزائد من أن يسهم تطور الذكاء الاصطناعي في إحكام قبضة الطغاة على مجتمعاتهم.

في ملمح مغاير، تبدو الحقيقة أكثر تعقيداً من ذلك، إذ يصنع التحيز المسبق مشكلة واضحة في كنف الديمقراطيات [يعني ذلك أن التحيز يظهر أيضاً لدى صناع الذكاء الاصطناعي، فيظهر في البيانات التي تصدر عنه]. ونظراً إلى شدة وضوحه، يمكن للمواطنين التخفيف من وطأته من خلال أشكال أخرى من ردود الفعل، كأن تحتج مجموعة عرقية معينة على خوارزميات التوظيف المتحيزة ضدها، وتأمل أن تنجح في نيل الإنصاف [الخوارزميات هي معادلات رياضية متشابكة تعتبر الأساس في الذكاء الاصطناعي، وهي “عقله” الفعلي]. وفي كنف الديكتاتوريات يكون الوضع مختلفاً. وبغض النظر عن مدى التحيز المعرفي في النظام السياسي الديكتاتوري، فإن مظاهره غالباً تكون غير واضحة، لا سيما بالنسبة إلى صناع القرار الرفيعي المستوى. ويفاقم ذلك صعوبة تصحيح التحيز المضمر، حتى إذا اقتنع القادة أساساً بضرورة التصحيح.

وعلى النقيض من الرأي المتعارف عليه، يمكن للذكاء الاصطناعي أن ينسف الأنظمة الأوتوقراطية من خلال تعزيز أيديولوجياتها وأوهامها، بدلاً من أي يقدم لها فهماً أفضل وأدق للعالم الحقيقي. وعندئذ، قد تكتشف الدول الديمقراطية أنه التحدي الرئيس في ما يتعلق بالذكاء الاصطناعي في القرن الحادي والعشرين ليس الفوز في معركة الهيمنة التكنولوجية، إنما التعامل مع الدول الاستبدادية العالقة في متاهات الوهم التي يغذيها الذكاء الاصطناعي.

رداءة التغذية الراجعة

تتطرق معظم مناقشات الذكاء الاصطناعي إلى تعلّم الآلات، بمعنى أنها تتناول الخوارزميات الإحصائية التي تستنبط العلاقات بين البيانات المتنوعة، كي تصل إلى تخمينات على شاكلة هل يوجد كلب في هذه الصورة؟ هل ستفوز هذه الاستراتيجية بلعبة الشطرنج في عشرة خطوات؟ ما هي الكلمة التالية في هذه الجملة غير المكتملة؟ إذا جاءت التخمينات في محلها، فإن ما يسمى “الوظيفة الموضوعية”، وهي وسيلة رياضية لتسجيل النتائج، ستكافئ الخوارزميات على نجاحها. وتجسد هذه العملية الطريقة الفعلية التي ينتهجها الذكاء الاصطناعي في عوالم التجارة اليوم. فمثلاً، ينشد “يوتيوب” زيادة تفاعل المستخدمين ومشاهداتهم كي يستمروا في قراءة الإعلانات. وعلى أساس ذلك، صمم الوظيفة الموضوعية [بخوارزميات الذكاء الاصطناعي] المتعلقة بذلك الهدف، بالتالي باتت تلك الخوارزميات تقدم محتوى يلفت انتباه المستخدمين ويبقي أعينهم مفتوحة على الصفحة. وتبعاً لتخمينات تلك الخوارزميات، أكانت صحيحة أم خاطئة، يجري تحديث النماذج التي يقدمها “يوتيوب” كي تحتوي على ما يحتمل أن يستجيب له المستخدمون.

وبفضل قدرة تعلّم الآلات على أتمتة حلقات ردود الفعل مع أو من دون تدخل بشري ضئيل، أعادت التجارة الإلكترونية تشكيل نفسها تمهيداً لظهور السيارات ذاتية القيادة في يوم من الأيام، لكن الوصول إلى مثل هذا التطور أصعب بكثير مما توقعه المهندسون، على غرار الأمر نفسه في الأسلحة ذاتية التشغيل. ويرجع السبب في ذلك إلى عجز الخوارزميات عن استيعاب المعطيات الفجائية التي يمكن أن تعترضها. وإذا تكدست المعطيات التي يسهل على الإنسان فهمها فيما يسيء تعلّم الآلات تصنيفها، ويشار إليها غالباً باسم “الآمثلة الأتية من الخصوم”، فسيتوقف عمل الخوارزميات وتتعطل العملية برمتها. ومن أبرز الأمثلة على ذلك، عدم تمكن نظام الرؤية الخاص بالسيارة ذاتية القيادة من التعرف على إشارة توقف وضعت عليها ملصقات بيضاء وسوداء. ويؤكد هذا الضعف في الخوارزميات بوضوح محدودية جدوى الذكاء الاصطناعي في زمن الحرب.

ومن يتوغل في أعماق تعقيدات تعلّم الآلات، سيفهم النقاشات التي تدور حول الهيمنة التكنولوجية وستتوضح له الأسباب الكامنة وراء اعتقاد بعض المفكرين أمثال عالم الكومبيوتر الصيني لي، بأهمية البيانات. فكلما زادت البيانات [المتوفرة لتعلّم الآلات] تحسنت سرعة أداء الخوارزميات التي تتعامل معهاس، مع إمكانية إدخال تغييرات هينة ومتتالية عليها حتى التوصل إلى تحقيق ميزة حاسمة فيها.

في المقابل، ثمة حدود لتعلّم الآلات. وعلى رغم الاستثمارات الهائلة التي تسخرها شركات التكنولوجيا في التجارة الإلكترونية، لا تزال الخوارزميات أقل فاعلية بكثير مما يشاع عنها، بالنسبة إلى حث الناس على شراء منتج متطابق بدلاً من آخر. وإذا كان التلاعب الموثوق بالتفضيلات السطحية أمراً صعباً، فإن تغيير الآراء والمعتقدات الراسخة في الأذهان لا شك أصعب بأشواط.

غالباً ما لا تملك الحكومات الاستبدادية أدنى فكرة عن طريقة سير الأمور في العالم

وفي سياق متصل، يعمل نظام الذكاء الاصطناعي العام [بمعنى غير المتخصص في عمليات محددة]، على استخلاص دروس من سياق معين ويطبقها في سياق آخر، على نحو ما يفعل الإنسان، بالتالي، فإنه يواجه محددات كثيرة. ومن شبه المؤكد أن نماذج “نتفليكس” في إحصاء ميول المستخدمين وتفضيلاتهم تختلف عن نماذج “أمازون”، مع العلم أن الشركتين كلتيهما تسعيان خلف نفس الأشخاص الذين يتعاملون مع قرارات متشابهة. واستطراداً، فإن الهيمنة في أحد قطاعات الذكاء الاصطناعي كتقديم مقاطع فيديو قصيرة تجتذب المراهقين (وهو انتصار حققه تطبيق “تيك توك”)، لا تنطبق بالضرورة على قطاع آخر، كتطوير أنظمة أسلحة ذاتية التشغيل تعمل في ساحات المعارك، إذ غالباً ما يعتمد نجاح الخوارزميات على المهندسين البشر القادرين على استخلاص الدروس عبر تطبيقات مختلفة، لا على التكنولوجيا نفسها. وحتى الآن، لا تزال هذه المشكلات تنتظر الحل.

وفي ذلك الصدد، يمكن للتحيز المعرفي المسبق أن يتسلل أيضاً إلى الشيفرة التي تدير الذكاء الاصطناعي. وقد ظهر دليل على ذلك حينما حاولت “أمازون” تطبيق تعلّم الآلات على التوظيف ودربت الخوارزمية على بيانات مستقاة من السير الذاتية التي سبق لوكلاء التوظيف البشريين أن أعطوا تقييماً لها، استنسخ نظام الذكاء الاصطناعي التحيزات المسبقة التي تنطوي عليها ضمناً قرارات البشر، بالتالي فقد مارس التمييز ضد السير الذاتية للنساء. ويمكن لمثل هذه المشكلات أن تدعم نفسها بنفسها. وبحسب عالم الاجتماع روها بنيامين، إذا ارتأى صناع السياسات استخدام تعلّم الآلات كوسيلة في تحديد المواقع التي ينبغي إيفاد الشرطة إليها، فقد يقودهم ذلك إلى تعزيز وجود الشرطة في الأحياء التي ترتفع فيها معدلات الاعتقال. وسيتضمن ذلك إرسال عناصر أمن إضافيين إلى المناطق التي تقطنها المجموعات العرقية المعرضة للتمييز من قبل الشرطة. وسيتمخض عن هذه الخطوة مزيد من الاعتقالات، ما سيعزز الخوارزميات التي يستند إليها الذكاء الاصطناعي، فتتولد حلقة مفرغة في ذلك الأمر.

وفي عالم اليوم حيث تؤثر المدخلات على المخرجات والعكس بالعكس، بات لمفهوم البرمجة القديم “مدخلات خاطئة، مخرجات خاطئة” Garbage in, Garbage out [اختصاراً، جيغوGiGo ] معنىً مختلفاً. فمن دون تصحيح خارجي مناسب، تنفتح الأبواب أمام خوارزميات تعلّم الآلات كي تعجب بالأخطاء التي سبق لها أن أنتجته بنفسها، فتتولد حلقة مفرغة من القرارات الخاطئة. وفي أحيان كثيرة، تعامل صناع السياسات مع الأدوات المستندة إلى تعلّم الآلات، بوصفها أدوات حكيمة ونزيهة، بدلاً من النظر إليها بوصفها أدوات غير معصومة يمكن أن تزيد من حدة المشكلات التي تزعم أنها تتولى حلها.

النداء والاستجابة

تعتبر الأنظمة السياسية أنظمة تعمل بطريقة التغذية الراجعة كذلك [في التغذية الراجعة، تؤثر نتائج إجراء معين على القرار في الاستمرار به أو التوقف عنه]. ففي الديمقراطيات، يحق للرأي العام حرفياً تقييم القادة والحكم عليهم في إطار انتخابات يفترض أن تكون حرة ونزيهة. وفيما تطلق الأحزاب السياسية الوعود هنا وهناك بقصد الفوز بالسلطة والتمسك بها، تصب المعارضة القانونية جل تركيزها على أخطاء الحكومة. كذلك تأخذ أقلام الصحافة الحرة، على عاتقها تسليط الضوء على خلافات هذه الأخيرة [الحكومة] وارتكاباتها. وبهذه الطريقة، يواجه القادة والمسؤولون ناخبيهم بصورة منتظمة ويتأكدون من مكانتهم في حسابات هؤلاء في دورة تتكرر باستمرار.

لكن، نظام التغذية الراجعة لا يعمل بشكل مثالي في الديمقراطيات، إذ تفتقر شعوب تلك المجتمعات إلى فهم عميق للسياسة فتحاسب الحكومات على أشياء خارجة عن سيطرتها. ويسيء السياسيون وموظفيهم تفسير رغبات الشعوب ومتطلباتها. وتنجرف المعارضة أيضاً خلف الكذب والرياء والمبالغة تحقيقاً لمصالحها الضيقة. ويضاف إلى ذلك أن خوض الانتخابات يكلف أموالاً كثيرة، وتتخذ القرارات الحقيقية أحياناً خلف الأبواب المغلقة وسط سياق إعلامي متحيز معرفياً أو يهتم بتسلية الجمهور أكثر من تثقيفه.

أياً يكن، تتكفل نظم التغذية الراجعة في جعل التعلّم ممكناً. فبفضلها، يتعلّم السياسيون ما تريده الشعوب. وتتعلّم الشعوب ما يمكن وما لا يمكن توقعه من السياسيين. وينتقد الناس أخطاء الحكومة علانية من دون خشية الاعتقال. ومع كل مشكلة جديدة، تتاح للمجموعات الجديدة فرصة تنظيم نفسها لتعميم المشكلة ومحاولة إقناع الآخرين بحلها. ومن شأن هذا كله أن يتيح لصناع السياسات والحكومات تحسين انخراطهم في عالم معقد ومتغير دوماً.

وفي الديكتاتوريات، تعمل أنظمة التغذية الراجعة بشكل مختلف كلياً عن الديمقراطيات، إذ لا يجري اختيار القادة عبر انتخابات حرة ونزيهة، بل بواسطة معارك خلافة قاسية وأنظمة غير شفافة في الترقية داخل النظام السياسي. وبوحشية، تحبط كل معارضة تتصدى لها الحكومات، حتى إن كانت قانونية. وإذا فكرت وسائط الإعلام بتوجيه سهام الانتقاد للمنظومات الحاكمة، فستكون الملاحقات القانونية والعنف لها بالمرصاد. وكل انتخابات تنظم في النظم الأوتوقراطية تكون ميالة بشكل منهجي إلى ترسيخ وجود المسؤولين المرابطين في الحكم. وكل فئة من المواطنين ترفع صوتها بالاعتراض، لا تجد صعوبة في رص صفوفها فحسب، بل تقابل كذلك بعقوبات قاسية، كعقوبتي السجن والموت. ولأجل هذه الأسباب مجتمعة، عادة ما لا تمتلك الحكومات الاستبدادية أدنى فكرة عن الطريقة التي يعمل بها العالم أو عما تريده من مواطنيها وما يرغب به الأخيرون منها.

وبالتالي، تواجه الديكتاتوريات مقايضة بين الاستقرار السياسي القصير الأجل وتطوير السياسات الفاعلة، إذ يدفع الأول القادة الاستبداديين إلى التصدي للجهات الخارجية ومنعها من التعبير الصريح عن مواقفها السياسية. وفي المقابل، يفرض الثاني [تطوير سياسات فاعلة] عليهم الاطلاع على ما يجري في مجتمعاتهم والعالم من حوادث، لكن في ظل الرقابة المشددة على المعلومات، من غير الممكن أن يحتكم القادة الاستبداديون إلى المواطنين ووسائل الإعلام وأصوات المعارضة لاستقاء تقييمات تصحيحية على غرار ما يفعل نظراؤهم الديمقراطيون، لذا نراهم يخاطرون بارتكاب فشل سياسي يمكن أن يقوض شرعيتهم وقدرتهم على الحكم على المدى الطويل. ويبدو أن هذا قد حدث فعلاً مع الرئيس الروسي فلاديمير بوتين حينما اتخذ قراره الكارثي بغزو أوكرانيا بالإستناد إلى تقييم غير دقيق للمعنويات الأوكرانية وقوة جيشه.

وقد استعان الحكام الاستبداديون بالمقاييس الكمية بديلاً بسيطاً وغير مباشر لملاحظات الرأي العام وردود فعله، حتى قبل ابتكار تعلّم الآلات. لنأخذ مثلاً جمهورية الصين التي حاولت على امتداد عقود طويلة الجمع بين اقتصاد السوق اللامركزي والإشراف السياسي المركزي على عدد قليل من الإحصاءات المهمة، لا سيما الناتج المحلي الإجمالي، إذ لا يترقى مسؤولوها المحليون إلا إذا تحركوا بسرعة لإنماء مناطقهم، لكن الرؤية المحدودة كمياً لبكين لم تمنحهم ما يكفي من الحوافز في معالجة القضايا المستشرية كالفساد والتلوث والدين العام. وما زاد الطين بلة مبادرة عديدين منهم، ربما بشكل غير مفاجئ، إلى التلاعب بالإحصاءات أو اتباع سياسات تعزز الناتج المحلي الإجمالي على المدى القصير، وتترك أمر المشكلات طويلة الأجل لمن سيخلفونهم في القيادة.

لا وجود لشيء من نوع سصنع القرار المتجرد من السياسة

وقد تمكن العالم من استراق النظر إلى هذه الدينامية أثناء أول استجابة صينية لوباء “كوفيد- 19” الذي انطلق من مقاطعة هوبي أواخر عام 2019. حينها، أبت السلطات المحلية في مدينة “ووهان”، عاصمة هوبي، استخدام النظام الإلكتروني للإبلاغ عن الأمراض المعدية الذي طورته الصين في أعقاب أزمة وباء “سارس” [الالتهاب التنفسي الشديد الحاد] عام 2003، وفضلت معاقبة الطبيب الذي حذر من وجود عدوى “تشبه سارس”. وبذلت حكومة “ووهان” قصارى جهدها لمنع وصول أي معلومة أو معطى في شأن تفشي المرض المستجد إلى بكين، مؤكدة مراراً وتكراراً “عدم وجود حالات جديدة”. وقد استمر الوضع على هذا المنوال إلى ما بعد اختتام عدد من الاجتماعات السياسية المحلية المهمة. وفي 7 فبراير (شباط)، توفي الطبيب لي وينليانغ جراء إصابته بالمرض الذي اكتشفه، مما أثار موجة غضب عارمة في جميع أنحاء البلاد.

وعلى أثر ذلك، تولت بكين حملة الاستجابة للجائحة وبدأت بتطبيق نهج “صفر كوفيد” المعتمد على فرض تدابير قسرية في احتواء العدوى والحد من انتشارها. وقد نجحت هذه السياسة بشكل جيد على المدى القصير، لكن قابلية الانتقال الهائلة لمتغير “أوميكرون” رفعت أكلاف انتصاراتها التي ما كانت لتتحقق لولا سلسلة الإقفالات العامة التي تركت الصينيين جياعاً والاقتصاد في حالة يرثى لها من جهة، وحافظت على مقياس واحد حاسم وبسيط، أي إبقاء عدد الإصابات منخفضاً، من جهة أخرى.

هل إنه فخ؟

لا يتمثل السؤال الأكثر إلحاحاً في فوز الولايات المتحدة أو الصين بسباق الهيمنة على الذكاء الاصطناعي. بالأحرى، يتناول ذلك السؤال الطريقة التي سيغير بها الذكاء الاصطناعي حلقات التغذية الراجعة المختلفة التي تعتمد عليها الديمقراطيات والأنظمة الاستبدادية في حكم مجتمعاتها. اقترح عديد من المراقبين أنه كلما أصبح تعللم الآلات أكثر انتشاراً في الأمكنة كلها، فإنه سيضر حتماً بالديمقراطية ويساعد الأنظمة الأوتوقراطية المستبدة. من وجهة نظرهم، قد تؤدي خوارزميات وسائل التواصل الاجتماعي التي تعمل على تحسين المشاركة مثلاً، إلى تقويض الديمقراطية من خلال الأضرار بجودة تعليقات المواطنين. حينما يتنقل الأفراد بين مقطع فيديو وآخر، تعمل الخوارزميات في موقع “يوتيوب” على إعطاء الأولوية للمحتوى الصادم والمثير بهدف الحفاظ على تفاعل الجمهور. وغالباً، يتضمن ذلك المحتوى نظريات المؤامرة أو الآراء السياسية المتطرفة التي تجذب الناس لأنها تجرهم إلى ما يشبه أرض عجائبية مظلمة تكون كل الأشياء فيها منقلبة رأساً على عقب.

على النقيض من ذلك، من المفترض أن يساعد تعلّم الآلات الأنظمة الاستبدادية من خلال تسهيل زيادة سيطرتها على شعوبها. في ذلك الصدد، يزعم المؤرخ يوفال هراري وعلماء آخرون أن الذكاء الاصطناعي “يميل إلى تفضيل الاستبداد”. وبحسب رأيهم، يعمل الذكاء الاصطناعي على زيادة تمركز البيانات والسلطة، ما يتيح للقادة التلاعب بالمواطنين العاديين من خلال تزويدهم بمعلومات محوسبة رقمياً تضغط على “الأزرار العاطفية” عندهم. ومع تكرار التغذية الراجعة المتأتية من تلك العملية [بمعنى تسجيل أعداد كبيرة من التفاعل معها]، تحصل استجابة جماعية من شأنها تكوين شكل فاعل وغير مرئي من الرقابة الاجتماعية. في المحصلة، تتيح وسائل التواصل الاجتماعي للحكومات الاستبدادية قياس نبض الجمهور مع الاستحواذ على قلبه أيضاً.

في المقابل، ليس من أدلة مؤكدة تساند تلك المحاججة. وعلى رغم أن التسريبات من داخل شركة “فيسبوك” تشير إلى أن الخوارزميات التي يعتمدها ذلك الموقع يمكنها بالفعل توجيه الأشخاص نحو المحتوى المتطرف، تشير أبحاث حديثة إلى أن الخوارزميات نفسها لا تغير ما يبحث عنه الأشخاص، بالتالي فمن المرجح أن يجري توجيه الأشخاص الذين يبحثون عن مقاطع فيديو متطرفة على موقع “يوتيوب” مثلاً، نحو مزيداً مما يبحثون عنه، لكن من غير المرجح أن يتبع الأشخاص الذين ليسوا مهتمين بالفعل بمحتوى خطر توصيات الخوارزميات. إذا أصبحت التعليقات في المجتمعات الديمقراطية مشوشة بشكل متزايد [بمعنى عدم حدوث زيادة منتظمة في التفاعل مع المحتويات المتطرفة والمثيرة]، فلن يسير تعلّم الآلات في مسار تبني الخطأ، بل سيقتصر دوره على تقديم يد العون إلى توجهات متنوعة.

ارتفاع مستوى تعلّم الآلات قد يدفع الأنظمة الاستبدادية إلى مزيد من القرارات السيئة

لا يوجد دليل قوي يساند الرأي القائل إن تعلّم الآلات بحد ذاته يفيد كل أنواع التحكم بالعقول بما يجوف الديمقراطية ويعزز الاستبداد. إذا لم تكن الخوارزميات فاعلة جداً في حمل الناس على شراء الأشياء، فمن المحتمل أن تكون أقل قدرة على تغيير رأيهم في شأن الأشياء التي تمس القيم الراسخة كالسياسة. لقد تكشفت تفاصيل المزاعم بأن شركة “كامبريدج آناليتيكا” Cambridge Analytica، وهي شركة استشارات سياسية بريطانية، استخدمت بعض الأساليب السحرية للتلاعب بانتخابات الرئاسة الأميركية عام 2016 لمصلحة دونالد ترمب، إذ يبدو أن الخلطة السرية التي يفترض أن تلك الشركة قدمتها إلى حملة ترمب، قد تكونت من التقنيات المعيارية المعروفة في الاستهداف المستند إلى القياسات السيكولوجية، عبر استخدام استطلاعات عن أنماط الشخصيات بحد تصنيف الأفراد ضمن فئات معينة، بالتالي فإن فائدتها كانت محدودة.

في الواقع، قد يتحول الاستبداد المؤتمت بالكامل المستند على البيانات إلى فخ في دول كالصين التي تتمركز السلطة فيها بيد مجموعة صغيرة معزولة من صناع القرار. في المقابل، تملك الدول الديمقراطية آليات تصحيح السياسات، تتمثل في أشكال بديلة من ردود فعل المواطنين التي تصنع تغذية راجعة تعمل على التحقق من عدم خروج الحكومات عن المسار الصحيح. ولا تملك الحكومات الاستبدادية آلية مشابهة، في الوقت الذي تضاعف فيه من تعلّم الآلات. وعلى رغم أن مراقبة الدولة المنتشرة في كل مكان يمكن أن تثبت فاعليتها على المدى القصير، تأتي إمكانية تقويض الدول الاستبدادية من أشكال التحيز المعرفي المسبق الذي يعزز نفسه بنفسه، الأمر الذي يصبح أكثر سهولة ضمن سياق تعلّم الآلات. نظراً إلى أن الدولة تستخدم تعلّم الآلات على نطاق واسع، فسيصل الأمر إلى وضع تعمل فيه أيديولوجية القائد على تشكيل الكيفية التي يجري بها تعلّم الآلات، وكذلك الأهداف التي يتمحور حولها ذلك التعلّم، إضافة إلى طرق وآليات تفسير نتائج البيانات. فمن المحتمل أن تعبر الخلاصات المتأتية من تلك العمليات، عن التحيزات المعرفية للقائد، فتعيدها إليه.

وفي ذلك الصدد، أوضح التقني ماتشييه سيغلوفسكي أن تعلّم الآلات هو “غسل أموال لمصلحة التحيز المعرفي. إنه أداة من الرياضيات النظيفة تمنح الوضع الراهن هالة الحتمية المنطقية”. فمثلاً، ماذا سيحدث حينما تبدأ الدول في استخدام تعلّم الآلات لغربلة شكاوى وسائل التواصل الاجتماعي وإزالتها؟ تتمثل الإجابة في أن القادة سيصعب عليهم بصورة متزايدة رؤية أخطاء السياسة ومعالجتها حتى حينما تضر تلك الأخطاء بالنظام.

لقد تكهنت دراسة أجريت عام 2013 أن الصين عملت على إزالة الشكاوى المقدمة عبر الإنترنت بأبطأ من المتوقع، تحديداً لأن الاحتفاظ بالشكاوى قدم معلومات مفيدة للقيادة، ولكن الآن، بعد أن باتت بكين تؤكد بشكل متزايد على التناغم الاجتماعي وتسعى إلى حماية كبار المسؤولين، سيكون من الصعب الحفاظ على ذلك النهج من عدم التدخل في الشكاوى المقدمة عبر الإنترنت.

المعلومات المضللة التي يغذيها الذكاء الاصطناعي قد تسمم البئر وتضر بالأنظمة الديمقراطية والأوتوقراطية على حد السواء

وفي الأقل، يدرك الرئيس الصيني شي جينبينغ هذه المشكلات في بعض مجالات السياسة. لقد ادعى منذ فترة طويلة أن حملته الرامية إلى مكافحة الفقر، تحديداً محاولته القضاء على الفقر الريفي، شكلت انتصاراً مميزاً مدعوماً من التقنيات الذكية والبيانات الضخمة والذكاء الاصطناعي. ومنذ ذلك الوقت، اعترف شي بوجود عيوب في الحملة، بما في ذلك حالات طرد فيها المسؤولون الناس من منازلهم الريفية وخبأوهم داخل شقق في المدن بهدف التلاعب بإحصاءات الفقر. مع عودتهم إلى الريف، فإنهم عادوا إلى براثن الفقر، مما أشعر شي بالقلق من أن “الأهداف الكمية الموحدة” لمستويات الفقر قد لا تكون النهج الصحيح في المستقبل. قد تكون البيانات هي النفط الجديد بالفعل، لكنها قد تلوث بدلاً من أن تعزز قدرة الحكومة على الحكم.

إن هذه المشكلة لها تداعيات على ما يسمى نظام الموثوقية الاجتماعية في الصين، ويتكون من مجموعة مؤسسات تتبع السلوك المؤيد للمجتمع. ويصف المعلقون الغربيون ذلك الأمر بأنه “نظام مراقبة مدعوم بالذكاء الاصطناعي ينتهك حقوق الإنسان”. وبحسب خبراء في سياسة المعلومات من بينهم شازيدا أحمد وكارين هاو، فإن النظام في الواقع أكثر فوضوية. وفي الواقع، يبدو نظام الموثوقية الاجتماعية الصيني مشابهاً لنظام الموثوقية الأميركي الذي تنظمه قوانين من نوع “قانون الإبلاغ العادل عن الموثوقية”، أكثر من كونه رؤية أورويلية متشائمة كلياً [إشارة إلى الكاتب البريطاني الشهير جورج أوريل وروايته “1984” التي وصف فيها نظاماً شمولياً يجعل الدولة أشبه بالسجن المراقب على مدار الساعة].

على نحو مماثل، قد يؤدي التوسع في تعلّم الآلات إلى مضاعفة عدد القرارات السيئة في الأنظمة الاستبدادية. إذا تدرب تعلّم الآلات على تحديد المعارضين المحتملين على أساس سجلات الاعتقال، فمن المحتمل أن يؤدي ذلك إلى تحيزات تعزز نفسها بنفسها تكون مماثلة لتلك التي شوهدت في الديمقراطيات. ويعني ذلك أنها ستعبر عن معتقدات المسؤولين (وتعززها أيضاً) حول المجموعات الاجتماعية المحرومة، ما يؤدي إلى استدامة الارتياب المؤتمت، وكذلك ردود الأفعال عليه، بلا هوادة. في الديمقراطيات، من الممكن حدوث رد فعل شعبي، مهما يشوبه من خلل. في الأنظمة الأوتوقراطية، تكون المقاومة أصعب بكثير. ومن دون مقاومة ملائمة، تغدو تلك المشكلات غير مرئية لمن هم داخل النظام بسبب تشارك المسؤولين والخوارزميات في الأحكام المسبقة نفسها. بدلاً من السياسة الجيدة، سيؤدي ذلك إلى زيادة الأمراض والاستياء والخلل الاجتماعي، ما يوصل في نهاية المطاف إلى الاضطرابات وعدم الاستقرار.

الذكاء الاصطناعي كسلاح

لن تصنع السياسات الدولية للذكاء الاصطناعي سباقاً مبسطاً على الهيمنة، إذ تؤدي النظرة غير المدققة إلى تلك التكنولوجيا بوصفها سلاحاً اقتصادياً وعسكرياً، والاعتقاد أن البيانات هي مصدر القوة، إلى إخفاء العمل الحقيقي الكبير الذي يفترض النهوض به في ذلك السياق. في الواقع، تتمثل أكبر العواقب السياسية للذكاء الاصطناعي في آليات التغذية الراجعة المعتمدة في الدول الديمقراطية والاستبدادية، إذ تشير بعض الأدلة إلى أن الذكاء الاصطناعي يشوش التغذية الراجعة في الديمقراطيات، على رغم أنه لا يلعب دوراً كبيراً، وفق ما يقترحه كثيرون. وعلى النقيض من ذلك، كلما تزايد اعتماد الحكومات الاستبدادية على تعلّم الآلات، توسع اندفاعها صوب عالم خيالي مستند إلى تحيزاتها المعرفية التي تضخمها التكنولوجيا. في عام 1998، بين الكتاب الكلاسيكي “أن ترى كأنك دولة” الذي وضعه العالم السياسي جيمس سكوت، كيف كانت دول القرن الـ 20 تتجاهل عواقب أفعالها جزئياً لأنها كانت ترى العالم من خلال التصنيفات والبيانات البيروقراطية وحدها. كذلك حاجج عالم الاجتماع ماريون فوركيد وآخرون، بأن تعلّم الآلات يطرح تلك المشكلات نفسها، لكن على نطاق أكبر. وتؤدي هذه الإشكالية إلى مراكمة مجموعة مختلفة كلياً من التحديات الدولية، في وجه ديمقراطيات كالولايات المتحدة. ومثلاً، استثمرت روسيا في أدوات تقنية تخدم حملات التضليل وترمي إلى زرع الارتباك والاضطراب بين الجمهور الروسي، أثناء تطبيق تلك الأدوات التقنية نفسها في البلدان الديمقراطية. على رغم أن المدافعين عن حرية التعبير أكدوا منذ فترة طويلة أن الرد على الكلام السيئ يتمثل في مزيد من الكلام، فقد قرر بوتين أن أفضل رد على مزيد من الكلام يتمثل في مزيد من الكلام السيئ، ثم استغلت روسيا أنظمة التغذية الراجعة المفتوحة في الديمقراطيات، كي تلوثها بمعلومات مضللة.

في سياق متصل، تتمثل إحدى المشكلات المتصاعدة بسرعة في كيفية عمل الأنظمة الأوتوقراطية على غرار روسيا، بتحويل النماذج اللغوية الكبيرة إلى سلاح، إذ يقدم ذلك شكلاً جديداً من أشكال الذكاء الاصطناعي يمكنه إنتاج نصوص أو صور، بالاستجابة إلى توجيه شفاهي، بغية توليد معلومات مضللة على نطاق واسع. وقد حذرت عالمة الكمبيوتر تمنيت غبرو وزملاؤها، من أن برامج كمبيوتر كنظام الذكاء الاصطناعي المفتوح المصدر “جي بي تي – 3” Open AI”s GPT-3، يمكنها إنتاج النصوص بطلاقة تجعلها على ما يبدو شديدة الشبه بالكتابة البشرية العادية. كذلك أطلق تطبيق “بلووم” Bloom، وهو نموذج لغة كبير جديد مفتوح الوصول، كي يستخدمه الناس كلهم. ويتضمن ترخيصه شرطاً يفرض على المستخدمين تجنب الإساءة، لكنه أمر يصعب التحكم به.

ستؤدي هذه التطورات إلى مشكلات خطرة في التغذية الراجعة ضمن الديمقراطيات. يكاد يكون من المؤكد أن الأنظمة الحالية في التعليقات عبر الإنترنت محكوم عليها بالفشل، لأنها تتطلب قليلاً من الأدلة لإثبات أن المعلق كائن بشري. وبالفعل، عمد مقاولو شركات الاتصالات الكبرى إلى إغراق “اللجنة الفيدرالية للاتصالات” الأميركية بتعليقات وهمية مرتبطة بعناوين بريد إلكتروني مسروقة كجزء من حملتهم ضد قوانين حيادية الإنترنت. ومع ذلك، بدا سهلاً التعرف إلى تلك الحيلة حينما نشر عشرات الآلاف من التعليقات المتطابقة تقريباً. الآن، أو في المستقبل القريب جداً، سيكون من السهل مثلاً حث نموذج لغوي كبير على كتابة 20000 تعليق مختلف تكون مكتوبة بأسلوب ناخبين متأرجحين ممن يدينون حيادية الإنترنت. وقد تعمل المعلومات المضللة التي يغذيها الذكاء الاصطناعي على تسميم البئر في الأنظمة الأوتوقراطية أيضاً، بينما تبث الحكومات الاستبدادية المعلومات المضللة في النقاش العام، سيصبح من الأسهل عليها تفتيت المعارضة. وفي المقابل، سيكون من الصعب أيضاً معرفة ما يعتقده الجمهور بالفعل، ما يعقد عملية صنع السياسات بشكل كبير. سيكون من الصعب بشكل متزايد على القادة الاستبداديين تجنب الامتلاء بالنشوة المتأتية مما بثوه هم أنفسهم في الفضاء العام، ما يؤدي بهم إلى الاعتقاد أن المواطنين يتسامحون أو حتى يحبون، سياسات لا تحظى بشعبية كبيرة فعلياً.

المشاركة في المخاطر

كيف سيكون شكل مشاركة العالم مع دول استبدادية كالصين إذا غرقت الأخيرة في لجة حلقات من التغذية الراجعة المغلوطة التي نجمت أصلاً عن طريقة استعمال تلك الدول للذكاء الاصطناعي؟ ماذا يحدث حينما تتوقف آليات التغذية الراجعة عن تقديم التوجيه السيبراني، وباتت تعبر بدلاً من ذلك مخاوف الحكام ومعتقداتهم؟ يتمثل أحد ردود الأفعال الأنانية التي قد تصدر من النظم الديمقراطية المنافسة في ترك الحكام المستبدين في قبضة أدواتهم الخاصة، استناداً إلى رؤية ترى أن كل ما يضعف الحكومات الاستبدادية هو مكسب صاف. في تلك الحالة، قد يؤدي ذلك النوع من رد الفعل الأناني، إلى كارثة إنسانية. ثمة عدد من التحيزات الحالية للدولة الصينية، كتلك المتضمنة في سياساتها تجاه الإيغور، تعمل بشكل خبيث ونشط، لككنها قد تصبح أسوأ بكثير. وفي مواقف ماضية، شملت عواقب عمى بكين عن الواقع حدوث المجاعة الكبرى التي أودت بحياة نحو 30 مليون شخص بين عامي 1959 و1961، وقد حركتها سياسات مؤدلجة، وأخفتها عدم رغبة المسؤولين الإقليميين في الإبلاغ عن إحصاءات دقيقة. حتى أشد المتشائمين تطرفاً يجب أن يدركوا المخاطر الكارثية التي قد تنجم عن سياسة خارجية يوجهها الذكاء الاصطناعي، في الصين ودول أخرى. ومثلاً، من خلال تضخيم التحيزات القومية، يمكن للذكاء الاصطناعي أن يعزز بسهولة المجموعات المتشددة التي تتطلع إلى الانخراط في غزو الأراضي.

قد تكون البيانات هي النفط الجديد، لكنها لن تعزز قدرة الحكومة على الحكم بقدر ما ستلوثها

وبشكل أشد تشاؤماً، قد يميل صانعو السياسة في الغرب إلى استغلال الحلقات المغلقة التي تولدها أنظمة المعلوماتية في الدول الاستبدادية. حتى الآن، ركزت الولايات المتحدة على تعزيز حرية الإنترنت في المجتمعات الاستبدادية. بدلاً من ذلك، فقد تحاول أن تفاقم مشكلات المعلوماتية في النظم الاستبدادية من خلال تعزيز حلقات التحيز المعرفي التي تكون هذه الأنظمة عرضة لها، إذ تستطيع الولايات المتحدة أن تفعل ذلك من طريق إفساد البيانات الإدارية أو نشر معلومات مضللة على وسائل التواصل الاجتماعي الاستبدادية. لسوء الحظ، لا يوجد جدار افتراضي يفصل بين الأنظمة الديمقراطية والأوتوقراطية، بالتالي فقد تتسرب البيانات السيئة والمعتقدات المجنونة من المجتمعات الأوتوقراطية إلى المجتمعات الديمقراطية. وفي المقابل، إن القرارات الاستبدادية الرهيبة يمكن تولد عواقب لا يمكن التنبؤ بها في البلدان الديمقراطية أيضاً، بينما تفكر الحكومات في الذكاء الاصطناعي، فإنها تحتاج إلى إدراك أننا نعيش في عالم مترابط، بالتالي، فمن المرجح أن تنتقل مشكلات الحكومات الاستبدادية إلى الديمقراطيات. إذاً، قد يتطلع نهج أكثر ذكاءً إلى التخفيف من نقاط الضعف في الذكاء الاصطناعي من خلال الترتيبات المشتركة للحوكمة الدولية. حاضراً، تتباين آراء أقسام مختلفة في الدولة الصينية في شأن الاستجابة المناسبة لمسألة فرض تشريعات وقوانين تتعلق بالذكاء الاصطناعي. وفي الصين مثلاً، تقدمت “إدارة الفضاء الإلكتروني”، و”أكاديمية تكنولوجيا المعلومات والاتصالات”، ووزارة العلوم والتكنولوجيا، باقتراحات عن مبادئ تنظيم الذكاء الاصطناعي. يفضل البعض اتباع نموذج السير من الأعلى إلى الأسفل [بمعنى البدء من الرئاسة والحكومة، وصولاً إلى المؤسسات الصغيرة والجمهور الواسع]، مما قد يقيد القطاع الخاص ويسمح للحكومة بحرية الحركة. في المقابل، يدرك آخرون، في الأقل بشكل ضمني، مخاطر الذكاء الاصطناعي على الحكومة أيضاً. قد تساعد صياغة مبادئ تنظيمية دولية واسعة في نشر المعرفة حول المخاطر السياسية للذكاء الاصطناعي. وقد يبدو هذا النهج التعاوني غريباً في سياق التنافس المتزايد بين الولايات المتحدة والصين، لكن السياسة المعدلة بعناية قد تخدم واشنطن وحلفاءها بشكل جيد. قد يتمثل أحد المسارات الخطرة بأن تنجرف الولايات المتحدة في سباق من أجل الهيمنة على الذكاء الاصطناعي، الأمر الذي من شأنه أن يوسع العلاقات التنافسية إلى أبعد من ذلك. واستطراداً، قد يتأتى المسار الخطر الآخر من محاولة مفاقمة السوء في مشكلات التغذية الراجعة في الأنظمة الاستبدادية، إذ يغامر المساران كلاهما بإمكانية حدوث كارثة وحرب محتملة. إذاً، قد يتمثل المسار الأكثر أماناً للحكومات جميعها بأن تدرك المخاطر المشتركة للذكاء الاصطناعي، وتتعاون كلها في العمل على الحد منها.