AIبالعربي – متابعات

تقييم النماذج باستخدام مقاييس النموذج (Model Metrics) هو عملية قياس أداء نموذج تعلم الآلة باستخدام مقاييس كمية محددة.

تهدف هذه العملية إلى تحديد دقة النموذج وموثوقيته وفعاليته في أداء المهمة التي صُمم من أجلها.

أهمية تقييم النماذج

يُعد تقييم النموذج خطوة حاسمة في دورة حياة تطوير نماذج تعلم الآلة. التقييم الدقيق يضمن جودة النموذج قبل نشره في بيئة الإنتاج. كما يساعد في مقارنة أداء نماذج مختلفة واختيار الأفضل.

بدون تقييم صحيح، قد يبدو النموذج جيدًا على بيانات التدريب لكنه يفشل في التعامل مع بيانات جديدة.

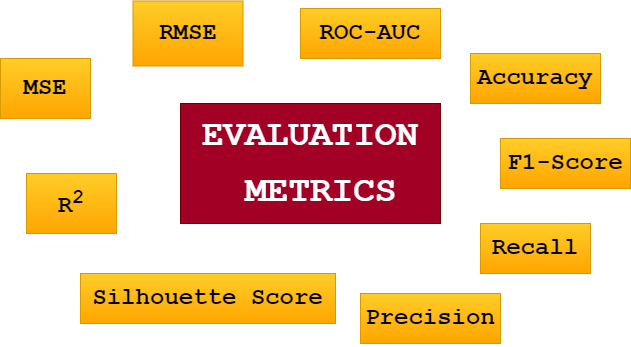

أنواع مقاييس التقييم الرئيسية

تختلف مقاييس التقييم حسب نوع مشكلة تعلم الآلة (تصنيف، انحدار، تجميع).

لمشاكل التصنيف: الدقة (Accuracy)، الاستدعاء (Recall)، الدقة (Precision)، درجة F1 (F1-Score)، ومنطقة تحت منحنى ROC (AUC-ROC).

لمشاكل الانحدار: متوسط الخطأ التربيعي (MSE)، جذر متوسط الخطأ التربيعي (RMSE)، متوسط الخطأ المطلق (MAE).

شرح مقاييس التصنيف الأساسية

• الدقة (Accuracy): نسبة التنبؤات الصحيحة إلى إجمالي التنبؤات. مناسبة عندما تكون الفئات متوازنة.

• الدقة (Precision): نسبة الحالات الإيجابية الصحيحة إلى إجمالي ما تنبأ به النموذج إيجابيًا. مهمة عندما تكون تكلفة الإنذار الخاطئ عالية.

• الاستدعاء (Recall): نسبة الحالات الإيجابية الصحيحة إلى إجمالي الحالات الإيجابية الفعلية. مهمة عند الحاجة لعدم تفويت أي حالة إيجابية.

• درجة F1 (F1-Score): متوسط توافقي بين الدقة والاستدعاء. مفيدة عندما تحتاج لتوازن بينهما.

اختيار المقياس المناسب

اختيار المقياس يعتمد على طبيعة المشكلة وتكلفة الأخطاء. في تشخيص مرض نادر، يكون الاستدعاء أهم من الدقة. في تصفية البريد الإلكتروني العشوائي، تكون الدقة أكثر أهمية لتجنب حذف رسائل مهمة.

يجب دائمًا النظر في سياق العمل الفعلي للنموذج عند اختيار المقاييس.

مقاييس الانحدار

تقيّم مدى قرب التنبؤات القيم الفعلية المستمرة.

MAE: سهل التفسير، يقيس متوسط حجم الأخطاء.

MSE و RMSE: تعطي وزنًا أكبر للأخطاء الكبيرة (بتربيع الفرق). RMSE يعطي النتيجة بنفس وحدة البيانات الأصلية.

منحنى ROC ومساحة AUC

منحنى ROC (Receiver Operating Characteristic) يصور العلاقة بين معدل الإيجابيات الحقيقية (Recall) ومعدل الإيجابيات الكاذبة عند عتبات تصنيف مختلفة. مساحة تحت المنحنى (AUC) تقيس قدرة النموذج على التمييز بين الفئات.

كلما اقتربت قيمة AUC من 1، كان أداء النموذج أفضل في التمييز.

مصفوفة الارتباك (Confusion Matrix)

أداة أساسية لفهم أداء النموذج بشكل مفصل. توضح الإيجابيات الحقيقية، الإيجابيات الكاذبة، السلبيات الحقيقية، والسلبيات الكاذبة. تُشتَق منها معظم مقاييس التصنيف.

التقييم على بيانات الاختبار والتحقق

يجب تقييم النموذج النهائي على مجموعة بيانات اختبار مُعزولة لم تُستخدم أثناء التدريب. يساعد التقسيم إلى (تدريب، تحقق، اختبار) في منع الإفراط في التخصيص (Overfitting).

التقييم على بيانات التحقق يساعد في ضبط معلمات النموذج.

أخطاء شائعة في التقييم

• الاعتماد على مقياس واحد فقط.

• التقييم على بيانات التدريب فقط.

• تجاهل عدم التوازن في توزيع الفئات.

• عدم مراعاة السياق الواقعي لتكاليف الأخطاء.

• عدم استخدام التحقق المتقاطع (Cross-Validation) عند توفر بيانات محدودة.

أدوات برمجية للمساعدة

توفر مكتبات مثل Scikit-learn في بايثون وظائف جاهزة لحساب جميع المقاييس الشائعة. توفر أدوات مثل TensorBoard وMLflow إمكانيات لتصور وتتبع نتائج التقييم عبر التجارب المختلفة.

الخلاصة

تقييم النموذج باستخدام Model Metrics ليس خطوة نهائية بل عملية مستمرة. يجب مراقبة أداء النموذج بعد النشر للتأكد من استمرار جودته مع تغير البيانات الواقعية. الاختيار الذكي للمقاييس وفهم ما تمثله هو مفتاح بناء نماذج فعالة وموثوقة.

ما الفرق بين الدقة (Accuracy) والدقة (Precision) في التصنيف؟

الدقة (Accuracy) تقيس إجمالي صحة النموذج، بينما الدقة (Precision) تقيس مدى دقته عندما يتنبأ بفئة إيجابية معينة.

متى أستخدم MSE بدلاً من MAE؟

استخدم MSE عندما تريد معاقبة الأخطاء الكبيرة بشكل أكبر، لأن تربيع الخطأ يجعلها أكثر وضوحًا في النتيجة النهائية.

ما هو الإفراط في التخصيص (Overfitting) وكيف يكشفه التقييم؟

الإفراط في التخصيص يحدث عندما يتعلم النموذج بيانات التدريب بشكل ممتاز لكن أداؤه ضعيف على بيانات جديدة. يُكشف بوجود فجوة كبيرة بين دقة التدريب ودقة الاختبار.

كيف أتعامل مع بيانات غير متوازنة عند التقييم؟

يجب تجنب الاعتماد على الدقة (Accuracy) فقط. استخدام مقاييس مثل درجة F1 أو AUC-ROC أكثر ملاءمة. يمكن أيضًا استخدام إعادة العينة للبيانات.

ما فائدة التحقق المتقاطع (Cross-Validation) في التقييم؟

التحقق المتقاطع يستخدم جميع البيانات للتدريب والاختبار عبر طيات مختلفة. يعطي تقديرًا أكثر استقرارًا وموثوقية لأداء النموذج، خاصة مع مجموعات البيانات الصغيرة.

اقرأ أيضًا: دور “Feature Engineering” في تعلم الآلة