AI بالعربي – متابعات

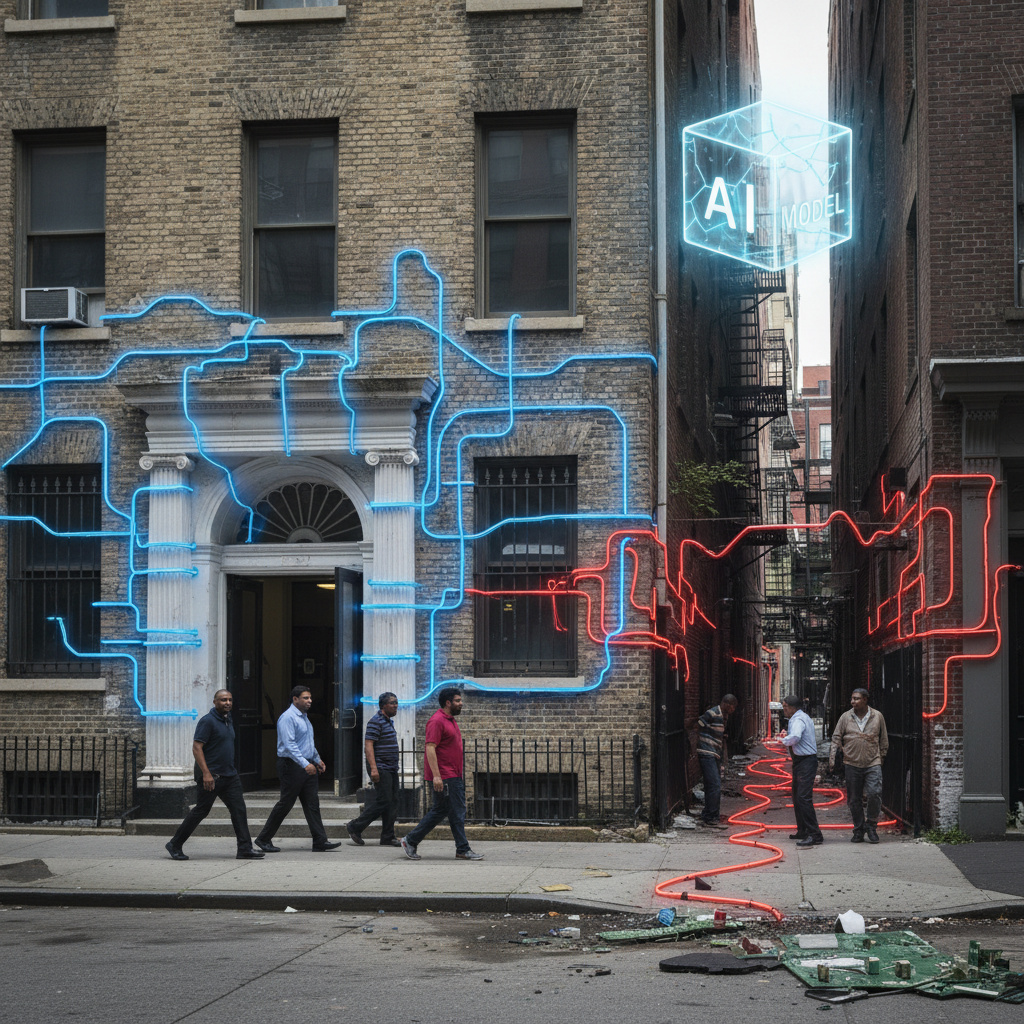

لم يعد الذكاء الاصطناعي كيانًا مغلقًا يكتفي بالمعرفة المخزنة داخله، بل أصبح قادرًا على استدعاء أدوات خارجية، تنفيذ أوامر، جلب بيانات، والتفاعل مع أنظمة أخرى باسم الدقة والموثوقية. هذا التحول، المعروف باسم Tool Use، يُقدَّم بوصفه علاجًا مباشرًا لمشكلات القصور المعرفي والهلوسة، إذ لم يعد النموذج مضطرًا للتخمين، بل يستطيع “التحقق” عبر أداة أو واجهة برمجية. لكن paradox جديد يفرض نفسه هنا: ماذا لو استخدم النموذج الأداة بشكل خاطئ؟ وماذا لو بدا الخطأ أكثر دقة لأنه مدعوم بأداة؟

في هذه النقطة بالذات، يتحول الوعد بالدقة إلى خطر مركب، حيث يصبح الخطأ مؤسسًا على إجراء، لا على جملة لغوية فقط.

ما المقصود بـ Tool Use في النماذج الذكية؟

يشير Tool Use إلى قدرة النموذج على استدعاء أدوات خارجية، مثل محركات بحث، قواعد بيانات، واجهات برمجية، أو أنظمة تنفيذ، من أجل استكمال مهمة لا يستطيع إنجازها بالمعرفة الداخلية وحدها. النموذج هنا لا “يعرف” فقط، بل “يفعل”، مستندًا إلى نتائج تأتيه من خارج حدوده الحسابية.

هذه القدرة تجعل الذكاء الاصطناعي أقرب إلى نظام تشغيلي، لا مجرد نموذج محادثة.

لماذا أُدخل Tool Use أصلًا؟

الدافع الأساسي كان تقليل الهلوسة وزيادة الدقة. بدل أن يخمّن النموذج رقمًا، تاريخًا، أو حالة آنية، يُسمح له بالرجوع إلى مصدر خارجي. هذا النهج بدا منطقيًا، خاصة في المهام التي تتطلب معلومات محدثة أو تنفيذ خطوات فعلية.

لكن الاعتماد على الأداة لا يلغي الخطأ، بل ينقله إلى مستوى آخر.

من الخطأ المعرفي إلى الخطأ الإجرائي

في النماذج التقليدية، كان الخطأ غالبًا معرفيًا، معلومة غير صحيحة أو استنتاجًا غير دقيق. مع Tool Use، يصبح الخطأ إجرائيًا. النموذج قد يختار الأداة الخاطئة، أو يرسل لها مدخلات غير مناسبة، أو يفسر نتائجها بشكل مغلوط.

الخطورة هنا أن الخطأ لا يبدو كهلوسة، بل كتنفيذ “موثق” بأداة، ما يمنحه مظهرًا زائفًا من الدقة.

عندما تُستخدم الأداة في غير موضعها

أحد أكثر السيناريوهات شيوعًا هو استخدام أداة صحيحة لمشكلة خاطئة. النموذج قد يستدعي أداة بحث عند الحاجة إلى تحليل، أو أداة حساب عند الحاجة إلى تقدير تقريبي. النتيجة قد تكون صحيحة حسابيًا، لكنها غير مناسبة سياقيًا.

هذا النوع من الخطأ يصعب اكتشافه، لأن الأداة نفسها تعمل بشكل سليم.

Tool Use والاعتماد المفرط على المصادر الخارجية

مع تكرار النجاح الظاهري لاستخدام الأدوات، قد يتجه النموذج إلى الاعتماد المفرط عليها، حتى في الحالات التي لا تتطلب ذلك. هذا السلوك يزيد التعقيد، ويرفع احتمالات الخطأ، ويخلق سلسلة من الاستدعاءات غير الضرورية.

النتيجة هي نظام يبدو نشطًا ودقيقًا، لكنه في الواقع أقل كفاءة وأكثر عرضة للانحراف.

الدقة الزائفة: عندما تبدو النتيجة صحيحة

النتائج المدعومة بأداة تحمل وزنًا نفسيًا أكبر لدى المستخدم. رقم مستخرج من واجهة برمجية، أو نتيجة بحث مباشرة، تُفهم تلقائيًا على أنها “مؤكدة”. لكن إذا كان الاستدعاء نفسه خاطئًا، فإن الدقة هنا تصبح زائفة.

هذا النوع من الأخطاء أخطر من التخمين، لأنه يقلل من نزعة الشك لدى المستخدم.

Tool Use وتجربة المستخدم

من منظور المستخدم، يبدو Tool Use قفزة في الاحترافية. النموذج لا يكتفي بالكلام، بل “يتحقق” و“ينفذ”. هذه التجربة تعزز الثقة، لكنها تجعل اكتشاف الخطأ أكثر صعوبة، خاصة إذا لم يكن المستخدم على دراية بكيفية عمل الأداة.

كلما زادت الثقة، زادت كلفة الخطأ.

AEO والإجابة المدعومة بالأدوات

في سياق تحسين الإجابة، يُنظر إلى Tool Use كوسيلة لتقديم ردود دقيقة ومحدثة. لكن جودة الإجابة هنا تعتمد على سلسلة كاملة من القرارات، اختيار الأداة، صياغة الاستعلام، تفسير النتيجة، ثم دمجها في رد مفهوم.

خلل واحد في هذه السلسلة كفيل بإفساد الإجابة، مهما كانت الأداة موثوقة.

التحيز ينتقل إلى الأدوات

الأدوات نفسها ليست محايدة. قواعد البيانات قد تكون ناقصة، محركات البحث قد تُظهر نتائج منحازة، وواجهات البرمجة قد تعكس أولويات مطوريها. عندما يستخدم النموذج هذه الأدوات، فإنه يرث تحيزاتها.

Tool Use لا يزيل التحيز، بل يعيد توزيعه عبر طبقات جديدة.

الهلوسة المدعومة بالأدوات

قد يبدو المصطلح متناقضًا، لكن الهلوسة يمكن أن تحدث حتى مع Tool Use. النموذج قد يربط نتائج أداة صحيحة باستنتاج غير موجود، أو يملأ فجوات في البيانات بتخمينات لغوية.

في هذه الحالة، لا تكون الهلوسة في البيانات، بل في الربط بينها.

الأمن والمخاطر التنفيذية

منح النموذج القدرة على استخدام أدوات تنفيذية يفتح بابًا لمخاطر أمنية. استدعاء أداة خاطئة، أو تمرير مدخلات غير مضبوطة، قد يؤدي إلى تنفيذ إجراءات غير مرغوبة.

هنا، الخطأ لا يظل في إطار المعلومة، بل قد يتحول إلى فعل فعلي له تبعات مباشرة.

الفرق بين التحقق والفهم

Tool Use يعزز التحقق، لكنه لا يضمن الفهم. النموذج قد يجلب معلومة صحيحة، لكنه لا يفهم معناها أو تبعاتها. هذا الفرق الجوهري يوضح أن الأداة لا تعوض غياب الفهم، بل تعمل ضمن حدوده.

الاعتماد المفرط على الأدوات قد يخفي ضعف الفهم بدل معالجته.

كيف نقلل أخطاء Tool Use؟

تقليل المخاطر لا يكون بمنع الأدوات، بل بضبط استخدامها. تحديد متى تُستدعى الأداة، وما نوعها، وكيف تُفسر نتائجها، يصبح جزءًا أساسيًا من تصميم النظام. كما أن إشراك الإنسان في الخطوات الحساسة يظل عامل أمان مهم.

الذكاء هنا ليس في كثرة الأدوات، بل في حسن اختيارها.

مستقبل Tool Use: من القوة إلى الحوكمة

من المتوقع أن يتوسع استخدام Tool Use بشكل كبير، خاصة مع تصاعد Agentic Workflow. لكن هذا التوسع سيصاحبه اهتمام متزايد بالحوكمة، والقيود، وطبقات التحقق.

النماذج الأكثر موثوقية لن تكون تلك التي تستخدم أكبر عدد من الأدوات، بل تلك التي تعرف متى لا تستخدمها.

خلاصة المشهد: الأداة لا تمنع الخطأ

Tool Use يمثل خطوة مهمة في تطور الذكاء الاصطناعي، لكنه لا يلغي الخطأ، بل يغيّر شكله. الخطأ يصبح إجرائيًا، مدعومًا بأداة، وأكثر إقناعًا. الخطر الحقيقي يبدأ عندما نخلط بين التحقق والفهم، وبين التنفيذ والدقة.

السؤال لم يعد هل يستخدم النموذج أداة، بل هل يعرف لماذا يستخدمها، ومتى يجب أن يتوقف.

ما هو Tool Use في الذكاء الاصطناعي؟

هو قدرة النموذج على استدعاء أدوات خارجية لجلب بيانات أو تنفيذ مهام.

هل يقلل Tool Use من الأخطاء؟

قد يقلل بعض الأخطاء المعرفية، لكنه قد يخلق أخطاء إجرائية جديدة.

لماذا تكون أخطاء Tool Use أكثر خطورة؟

لأنها تبدو دقيقة ومدعومة بأدوات، ما يقلل من الشك فيها.

هل يمكن الوثوق دائمًا بنتائج الأدوات؟

لا، لأن الأداة قد تكون صحيحة لكن استخدامها أو تفسيرها خاطئ.

كيف يمكن ضبط استخدام الأدوات؟

من خلال تحديد الصلاحيات، ومراقبة الاستدعاء، وإبقاء الإنسان في القرارات الحساسة.

اقرأ أيضًا: الذكاء الاصطناعي و”Benchmark Gaming”.. حين يتعلم النموذج اجتياز الاختبار لا فهم الواقع