“AI Slop”.. الوجه المظلم للذكاء الاصطناعي

AI بالعربي – خاص

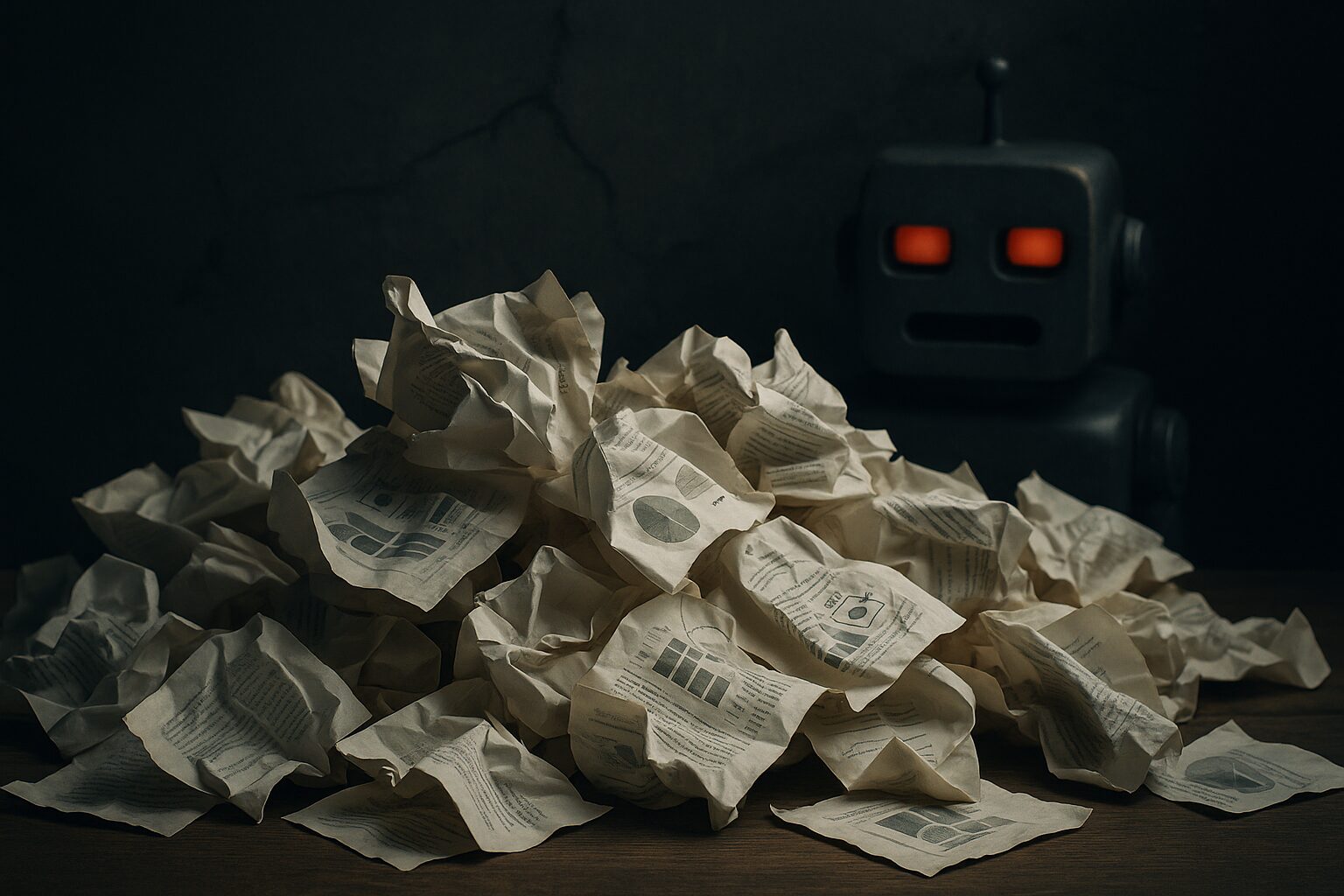

مع الانتشار المتسارع لتقنيات الذكاء الاصطناعي التوليدي خلال السنوات الأخيرة، برز مصطلح جديد أثار جدلًا واسعًا في الأوساط التقنية والإعلامية: “حثالة الذكاء الاصطناعي: AI Slop”. هذا التوصيف الساخر يُطلق على الكمّ الهائل من المحتوى الرديء أو الفوضوي الذي تنتجه الخوارزميات بلا جودة ولا قيمة معرفية حقيقية. وبين من يراه خطرًا يهدد المعرفة، ومن يعتبره مجرد مرحلة طبيعية في مسار التطور التقني، يظل التحدي الأكبر هو القدرة على التمييز بين الإنتاج الهادف وما هو مجرد “ضوضاء رقمية”.

من أين جاء المصطلح؟

ظهر المصطلح بدايةً في النقاشات الرقمية وعلى منصات السوشيال ميديا، قبل أن تتبناه الصحافة المتخصصة. وهو مشتق من كلمة Slop الإنجليزية التي تعني “المخلفات” أو “الطعام الملقى”، في إشارة إلى المحتوى المكرر أو “النفايات الرقمية” الناتجة عن الإفراط في استخدام أدوات الذكاء الاصطناعي لإنتاج نصوص وصور وفيديوهات بلا إبداع أو تدقيق.

مخاطر تتجاوز الرداءة

لا تتوقف خطورة «حثالة الذكاء الاصطناعي» عند حدود الرداءة الشكلية، بل تمتد إلى آثار أعمق ترتبط بالاعتماد على بيانات غير دقيقة وإعادة تدوير محتوى قديم بصورة آلية، وهو ما يؤدي إلى تلوث الإنترنت بفيض من النصوص المكررة أو المزيفة. وقد سلطت مراجعة تحليلية لموقع LiveScience الضوء على هذه الظاهرة، موضحة أن انتشار “AI Slop” أصبح حقيقة ملموسة تهدد كيفية استخدامنا للإنترنت في المستقبل، خاصة مع صعوبة التمييز بين المحتوى الحقيقي والمزيّف.

انتقادات لاذعة

تتسع رقعة الانتقادات الموجهة إلى هذه الظاهرة باعتبارها انعكاسًا لغياب المسؤولية في توظيف الذكاء الاصطناعي، إذ يُنتج محتوى ضخم بسرعة قياسية لكنه يفتقر للعمق والمعرفة ويهدد فرص المبدعين الحقيقيين في الوصول إلى الجمهور.

وفي تقرير نشره موقع Axios في سبتمبر 2025، تبيّن أن ما وصفه بـ”workslop” أو المحتوى الذي يبدو منسقًا لكنه فارغ المضمون، يُكلف الموظفين ما يقارب 186 دولارًا شهريًا بسبب ضياع الوقت والجهد في مراجعة مواد غير مفيدة، وبهذا فإن مصطلح AI Slop يتجاوز كونه مجرد توصيف ساخر إلى كونه إنذارًا بمخاطر حقيقية تواجه صناعة المحتوى في عصر الذكاء الاصطناعي.

وبينما تحمل هذه التقنيات وعودًا هائلة للإبداع والتطوير، يبقى التحدي في وضع معايير واضحة وضوابط تنظيمية تقلل من مخاطر التضليل، وتضمن إنتاج محتوى مسؤول يحافظ على قيمة المعرفة وجودتها.

تحذيرات علمية

في المقابل، يذهب البعض إلى أن المشكلة ليست في التقنية نفسها بل في طريقة استخدامها. غير أن هذا الطرح يواجه بدوره تحذيرات علمية، إذ أظهرت دراسة نشرها موقع LiveScience أن روبوتات الدردشة بالذكاء الاصطناعي تميل إلى تبسيط الدراسات العلمية وإغفال تفاصيل أساسية، خصوصًا في الأبحاث الطبية، وهو ما يؤدي إلى تقديم صورة ناقصة وربما مضللة للقارئ.