AI بالعربي – متابعات

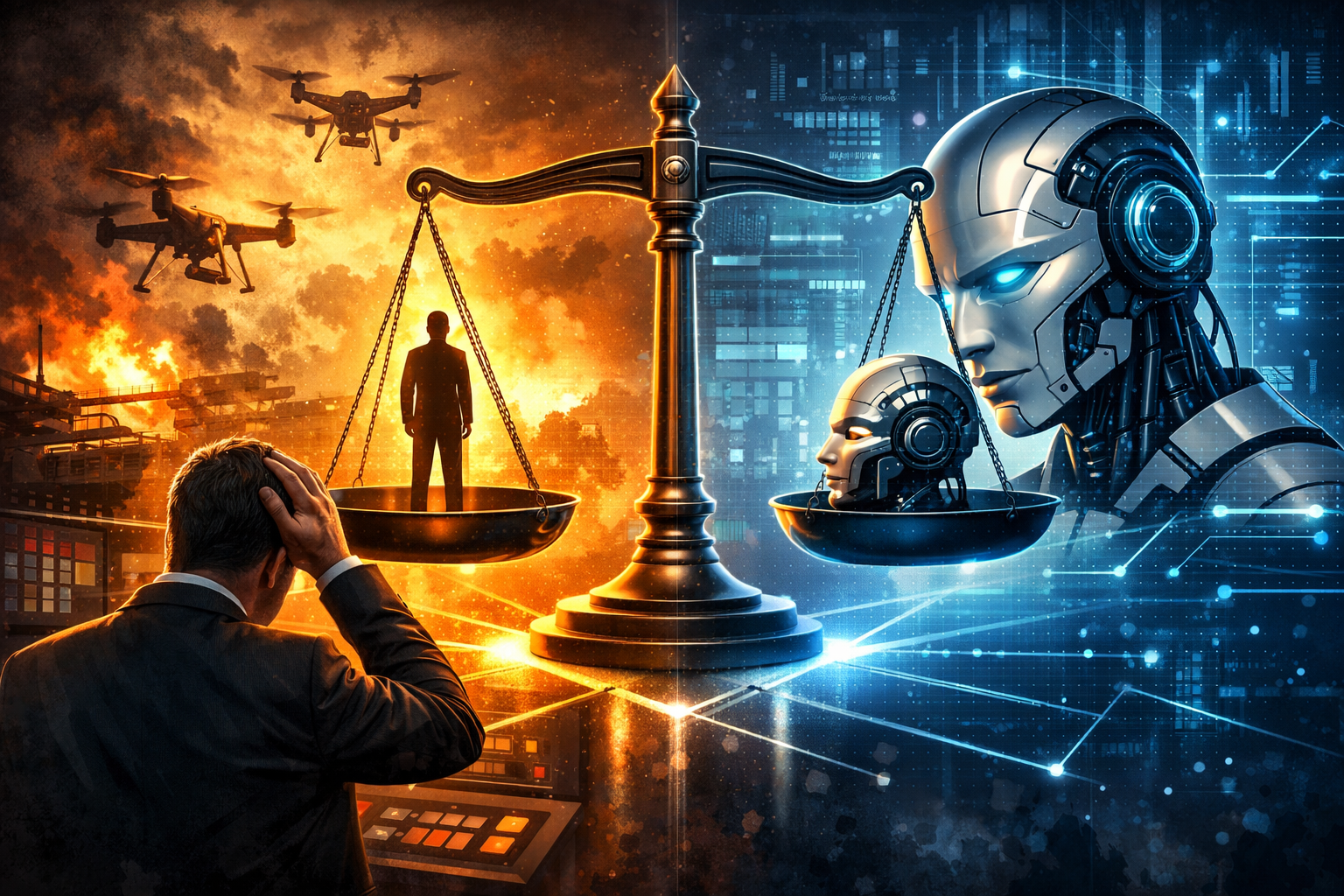

يتزايد الجدل عالميًا حول قدرة البشر على اتخاذ القرار النهائي في البيئات التي تعتمد على الذكاء الاصطناعي، إذ تكشف التجارب العملية أن سرعة الأنظمة الذكية وقوتها التحليلية تضع الإنسان أمام معادلة معقدة بين الثقة والتردد. وفي ظل هذا التحول التقني المتسارع، يظل السؤال الأهم حاضرًا: هل يستطيع البشر حقًا الاحتفاظ بالسيطرة الفعلية على القرارات المصيرية.

تشير تحليلات متخصصة إلى أن مستويات المخاطر في المؤسسات تحدد مدى اعتمادها على الذكاء الاصطناعي، حيث يزداد تمسك الإدارات بسلطة القرار البشري كلما ارتفعت حساسية النتائج المحتملة. وترى الكاتبة سارة أوكونر في صحيفة “فاينانشال تايمز” أن الحل الأكثر بديهية في البيئات عالية المخاطر يتمثل في الإبقاء على الإنسان بوصفه صاحب القرار النهائي، حتى مع توسع استخدام الأنظمة الذكية.

في ساحات النزاعات العسكرية، يتجلى هذا التردد بصورة أوضح، إذ تدور نقاشات تنظيمية مستمرة حول الفارق بين الأسلحة المستقلة بالكامل وتلك التي تبقى تحت “سيطرة بشرية”. وقد برزت خلافات حديثة بين شركة “أنثروبيك” والجهات التنظيمية الأميركية بشأن حدود استخدام الأنظمة القتالية الذكية. ويعكس هذا الجدل مخاوف متزايدة من فقدان الإنسان القدرة على التدخل في اللحظات الحاسمة.

ولا يختلف المشهد كثيرًا داخل الشركات الكبرى، حيث دفعت القدرات المتقدمة للوكلاء شبه المستقلين المؤسسات إلى تعزيز الرقابة البشرية على القرارات المدعومة بالذكاء الاصطناعي. وتشير تقارير إلى أن شركة “أمازون” تطلب من المهندسين المبتدئين والمتوسطين الحصول على موافقة خبراء أكثر خبرة قبل اعتماد أي تغييرات تقنية تعتمد على أدوات ذكية مثل ChatGPT أو حلول مشابهة.

لكن التحدي لا يقتصر على الرقابة التنظيمية، بل يمتد إلى طبيعة العلاقة النفسية بين الإنسان والآلة. فمنذ خمسينيات القرن الماضي، حاول الباحثون وضع أطر واضحة لتوزيع المهام بين الطرفين. ففي عام 1951، قدم عالم النفس بول فيتز قائمة توضح المجالات التي يتفوق فيها الإنسان وتلك التي تتقنها الآلة. ومع ذلك، تكشف التطورات الحالية أن البشرية لم تستفد بما يكفي من دروس الماضي.

تكمن إحدى أبرز المشكلات في الفجوة الزمنية بين قدرة الذكاء الاصطناعي وسرعة الاستجابة البشرية. فالأنظمة الذكية تستطيع تحليل كم هائل من البيانات خلال ثوانٍ، بينما يحتاج الإنسان إلى وقت أطول للتقييم واتخاذ القرار. وفي البيئات العسكرية مثلًا، يؤدي تسريع ما يعرف بـ”سلاسل القتل” إلى تقليص مساحة التفكير البشري، ما يجعل فكرة السيطرة الإنسانية أقرب إلى الوهم منها إلى الواقع.

وفي بيئات العمل المؤسسية، تظهر هذه الظاهرة بصورة مختلفة لكنها لا تقل تأثيرًا. إذ تضاعف الأنظمة الذكية حجم الإنتاج وسرعته، بينما يتحمل الموظفون عبء المراجعة والتوجيه. وقد كشفت دراسة امتدت ثمانية أشهر في شركة تكنولوجية أميركية أن الزيادة الكبيرة في الإنتاجية صاحَبَها ارتفاع في مستويات الإرهاق الذهني وتراجع في جودة القرارات النهائية.

تتفاقم التحديات أيضًا بسبب ما يعرف بـ”انحياز الأتمتة”، وهو الميل النفسي إلى الوثوق بالآلة حتى في حالات الشك. فقد سجلت حوادث عديدة اتبع فيها سائقون تعليمات أنظمة الملاحة حتى وصولهم إلى مناطق خطرة، كما أظهرت تجارب تعليمية أن طلابًا ساروا خلف روبوتات بدائية بعيدًا عن مخارج الطوارئ خلال محاكاة لحريق.

وفي تجربة أجرتها شركة “فولفو”، سمح نحو 30% من المشاركين لسيارة شبه ذاتية القيادة بالاصطدام بعائق واضح في الطريق. وتكشف هذه النتائج عن ظاهرة أعمق وصفها باحثون في كلية “وارتون” بمصطلح “الاستسلام الإدراكي”، وهي الحالة التي يتخلى فيها الإنسان عن حكمه الشخصي ويعتمد كليًا على توصيات النظام الذكي.

تتزايد التعقيدات عندما يتعلق الأمر بتحديد المسؤولية عند وقوع الأخطاء. إذ يطرح الخبراء تساؤلات جوهرية حول الجهة التي تتحمل اللوم في الأنظمة المعقدة. هل يتحمل الإنسان الذي وافق على القرار المسؤولية، أم يتحملها النظام الذي قدم التوصية. وتصف الباحثة مادلين كلير إيليش هذه الحالة بأنها “منطقة الانهيار الأخلاقي”، حيث يتحمل الفرد العبء القانوني والمعنوي لفشل منظومة تقنية واسعة.

ورغم هذه التحديات، تقدم بعض القطاعات نماذج ناجحة للتوازن بين الإنسان والآلة. ففي مجال الطيران مثلًا، طورت الشركات برامج تدريب تركز على فهم آليات الأتمتة وحدودها. كما تشجع الطيارين على التحكم اليدوي خلال بعض الرحلات للحفاظ على مهاراتهم وتعزيز قدرتهم على التدخل في الحالات الطارئة.

توضح هذه التجارب أن تحقيق التكامل بين الذكاء الاصطناعي والخبرة البشرية يتطلب وعيًا عميقًا بطبيعة التكنولوجيا ومخاطرها. فالسرعة والدقة اللتان توفرهما الأنظمة الذكية تمثلان فرصة هائلة، لكنهما قد تتحولان إلى مصدر خطر إذا فقد الإنسان القدرة على التقييم المستقل.

في نهاية المطاف، يبدو أن التحدي الحقيقي لا يكمن في تطوير التقنيات بحد ذاتها، بل في بناء منظومة معرفية وتنظيمية تحافظ على دور الإنسان بوصفه مركز القرار. ويؤكد تاريخ التفاعل بين البشر والآلات أن الحفاظ على هذه المعادلة يتطلب تدريبًا مستمرًا وفهمًا نقديًا للتكنولوجيا. فالوهم بالسيطرة قد يكون أكثر خطورة من فقدانها فعليًا، خاصة في عالم تتسارع فيه الابتكارات بوتيرة غير مسبوقة.