AI بالعربي – متابعات

مع تصاعد الطلب المؤسسي على نماذج لغوية مخصصة، دون تحمل كلفة إعادة تدريب كاملة، ظهر اسم LoRA – Low-Rank Adaptation بوصفه حلًا تقنيًا ذكيًا، بل وأقرب إلى “حيلة هندسية” تغيّر سلوك نموذج ضخم عبر تدخل صغير نسبيًا.

لكن خلف هذا الوعد العملي، يبرز سؤال أعمق من السرعة والكلفة: كيف يمكن لطبقة صغيرة أن تعيد تشكيل طريقة تفكير نموذج كبير؟ وهل نحن أمام تخصيص مرن يحافظ على جوهر النموذج، أم أمام إعادة توجيه سلوكي خفي قد تكون آثاره أعمق مما يبدو؟

هذا المقال يحلل LoRA بوصفه أكثر من تقنية تحسين، ويتناول أثره على فهمنا لطبيعة النماذج اللغوية، وحدود التخصيص، والعلاقة بين “الوزن الصغير” و”القرار الكبير”.

ما هي LoRA ولماذا لفتت الانتباه؟

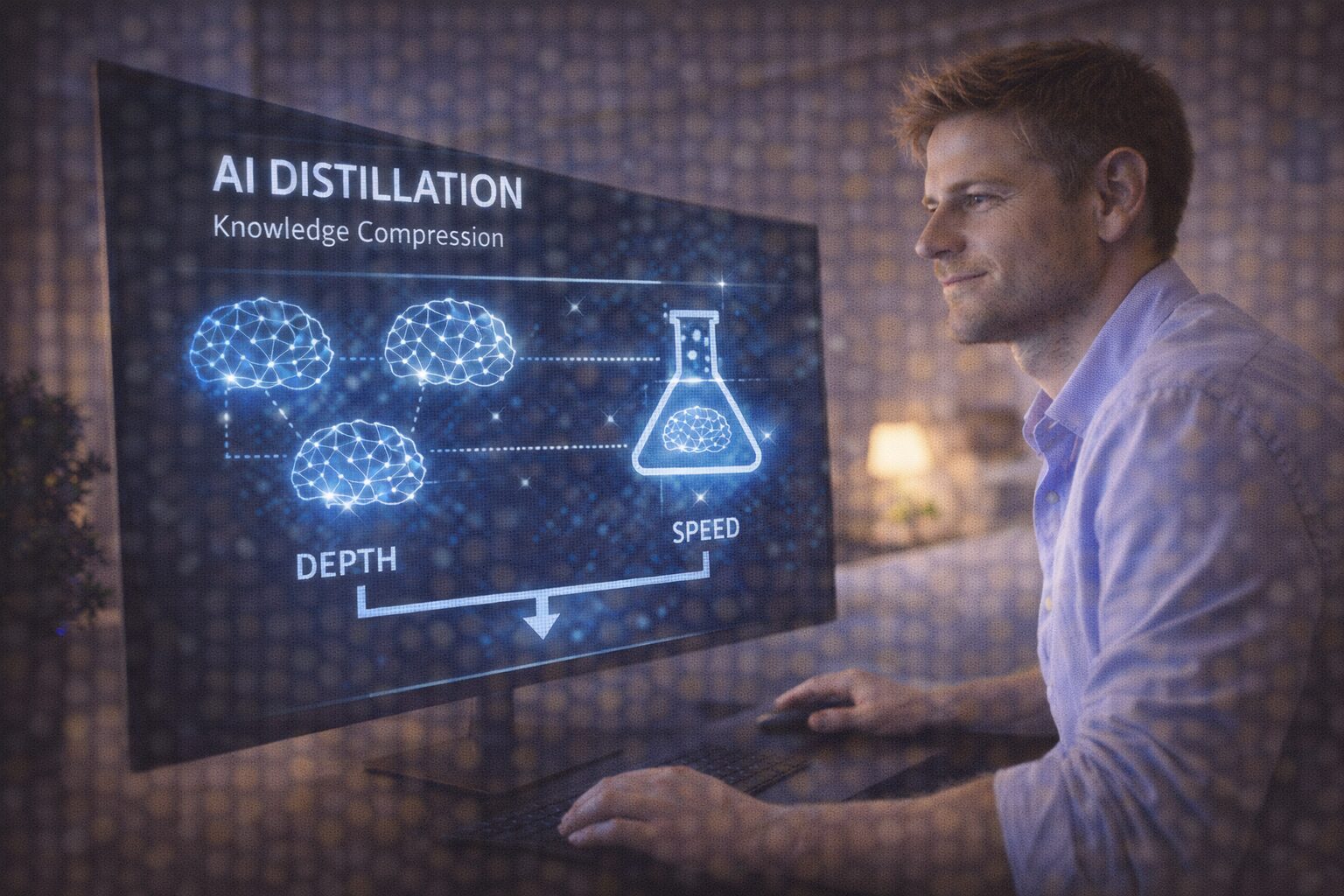

LoRA هي تقنية تهدف إلى تخصيص النماذج اللغوية الكبيرة دون تعديل أوزانها الأساسية. بدلًا من إعادة تدريب ملايين أو مليارات المعلمات، تُضاف طبقات صغيرة منخفضة الرتبة تُدرَّب على مهمة أو سياق معين، بينما يبقى النموذج الأصلي كما هو.

النتيجة العملية واضحة:

تكلفة أقل

زمن تدريب أقصر

مرونة في النشر

إمكانية التراجع أو التبديل بسهولة

لكن الأثر المعرفي أقل وضوحًا، وأكثر إثارة للتساؤل.

فكرة بسيطة وتأثير غير بسيط

من الناحية الرياضية، تعتمد LoRA على فرضية أن التغييرات المطلوبة لتخصيص النموذج لا تحتاج إلى تعديل كامل الفضاء التمثيلي، بل يمكن تمثيلها في بعد منخفض نسبيًا.

هذا يعني أن النموذج “يعرف بالفعل” الكثير، وكل ما يحتاجه هو إزاحة خفيفة في طريقة استخدام هذه المعرفة.

لكن هذه الإزاحة الخفيفة قد تغيّر نبرة الإجابة، وزاوية التحليل، وحدود المسموح والممنوع، دون أن يلاحظ المستخدم أن “الذكاء” نفسه لم يتغير جذريًا.

كيف تغيّر طبقة صغيرة السلوك؟

النماذج اللغوية لا تعمل كقواعد ثابتة، بل كنظم احتمالية شديدة الحساسية.

تغيير صغير في الأوزان قد يعيد ترتيب الاحتمالات، ويجعل مسارات لغوية معينة أكثر ترجيحًا من غيرها.

LoRA لا تضيف معرفة جديدة بالضرورة، لكنها تعيد ترجيح ما يُقال وما يُهمل.

وهذا كافٍ لتغيير السلوك.

الإجابة نفسها قد تصبح:

أكثر تحفظًا

أكثر تخصصًا

أكثر امتثالًا

أو أكثر جرأة

دون أن تتغير البنية العميقة للنموذج.

LoRA كتعديل في “طريقة الكلام” لا “مخزون المعرفة”

أحد المفاتيح لفهم LoRA هو إدراك أنها غالبًا لا تغيّر ما يعرفه النموذج، بل كيف يعبّر عنه.

النموذج قد يمتلك المعرفة نفسها قبل وبعد التخصيص، لكن طريقة تقديمها تتبدل.

هذا يجعل LoRA أداة قوية لضبط الأسلوب، والنبرة، والسياق المؤسسي، دون المخاطرة بإفساد المعرفة العامة للنموذج.

لكن في الوقت نفسه، يجعل أثرها أقل وضوحًا وأكثر تسللًا.

الفرق بين Fine-tuning وLoRA

في Fine-tuning التقليدي، تُعاد كتابة أجزاء من ذاكرة النموذج.

أما في LoRA، فالذاكرة تبقى، لكن يُضاف “مرشح” جديد يوجّه استخدامها.

Fine-tuning يغيّر النموذج من الداخل.

LoRA تغيّر طريقة تفاعله مع السؤال.

الأول أشبه بإعادة تعليم.

والثاني أشبه بتغيير زاوية الرؤية.

هذا الفرق يجعل LoRA مغرية للمؤسسات، لكنه يفتح بابًا لسوء الفهم.

التخصيص السريع: ميزة أم مخاطرة؟

سهولة LoRA وسرعتها تجعلها جذابة للتجريب السريع.

يمكن بناء عدة تخصيصات، وتبديلها حسب الاستخدام.

لكن هذه السهولة قد تُغري بالاستخدام غير المدروس.

تخصيص هنا.

طبقة هناك.

سلوك يتغير دون مراجعة شاملة.

التخصيص السريع قد يتحول إلى تراكم غير مرئي من التعديلات السلوكية.

LoRA والتحيز: إعادة توجيه أم تضخيم؟

عندما تُدرَّب LoRA على بيانات منحازة، فإنها لا تخلق التحيز من الصفر، لكنها قد تضخّمه عبر إعادة ترجيح أنماط معينة.

التحيز هنا يصبح أكثر كفاءة، لا أكثر وضوحًا.

النموذج قد يبدو متوازنًا ظاهريًا، لكنه يميل باستمرار إلى زوايا بعينها.

وهذا الميل يصعب اكتشافه، لأنه لا يأتي من تغيير جذري، بل من انحراف احتمالي صغير ومتكرر.

LoRA والامتثال المؤسسي

في السياقات المؤسسية، تُستخدم LoRA غالبًا لضبط النموذج مع السياسات الداخلية.

ما يُقال

ما يُتجنب

كيف تُصاغ الإجابة

وأين تتوقف

LoRA تنجح في ذلك بامتياز، لأنها لا تحتاج إلى إعادة تدريب شامل، بل إلى “توجيه ناعم”.

لكن هذا التوجيه الناعم قد يحوّل النموذج من مستشار إلى أداة امتثال لغوي، تُنتج إجابات منسجمة أكثر مما هي تحليلية.

الطبقة الصغيرة والقرار الكبير

الخطورة هنا ليست في حجم الطبقة، بل في موقعها.

LoRA تُضاف في نقاط حساسة من النموذج، حيث تتشكل التمثيلات العليا للمعنى.

التغيير الصغير في هذه النقاط قد يؤثر على قرارات كبيرة، خاصة في:

التوصية

التحليل

التلخيص

صياغة السياسات

وهذا يجعل من الضروري فهم LoRA بوصفها أداة حوكمة، لا مجرد تحسين أداء.

هل LoRA أقل خطورة من Fine-tuning؟

من حيث الاستقرار، نعم.

من حيث الشفافية، ليس بالضرورة.

لأن Fine-tuning يترك آثارًا أوضح يمكن تتبعها.

أما LoRA، فتعمل كطبقة إضافية يمكن إزالتها أو تبديلها، ما يجعل أثرها مؤقتًا ظاهريًا، لكنه عميق أثناء الاستخدام.

الخطر هنا ليس في الديمومة، بل في الخفاء.

LoRA والنماذج متعددة الاستخدام

في النماذج التي تُستخدم لأغراض متعددة، تبرز ميزة LoRA بوضوح.

يمكن تحميل تخصيص معين لمهمة محددة، ثم إزالته.

لكن هذا يطرح سؤالًا جديدًا:

أي نسخة من النموذج نتعامل معها؟

ومتى؟

وبأي سياق؟

الذكاء هنا يصبح متغيرًا حسب الطبقة المحمّلة، لا ثابتًا.

المستخدم: هل يعرف أي نموذج يخاطبه؟

في كثير من الحالات، لا يعلم المستخدم أن النموذج الذي يتفاعل معه يحمل LoRA مخصصة.

الإجابة تبدو طبيعية.

النبرة متسقة.

لكن السلوك موجه.

غياب هذا الوعي قد يجعل المستخدم يظن أن ما يسمعه هو “حقيقة عامة”، بينما هو في الواقع ناتج عن تخصيص دقيق.

الشفافية هنا ليست ترفًا، بل ضرورة أخلاقية.

LoRA في السياق العربي

في اللغة العربية، حيث تلعب النبرة والسياق دورًا حاسمًا، يمكن لـ LoRA أن تغيّر الكثير بقليل.

اختيار مفردة بدل أخرى

تقديم جملة وتأخير أخرى

تخفيف أو تشديد نبرة

هذه التغييرات الصغيرة قد تؤثر على الفهم، والاقتناع، وحتى الموقف العاطفي.

LoRA هنا أداة قوية، لكنها تحتاج حساسية ثقافية عالية.

هل يمكن استخدام LoRA بوعي؟

نعم، إذا استُخدمت ضمن إطار واضح.

تحديد هدف التخصيص بدقة

مراجعة البيانات المستخدمة

اختبار السلوك خارج السيناريوهات المتوقعة

تقييم الأثر قبل التعميم

LoRA ليست خطرًا بحد ذاتها، بل تصبح كذلك عندما تُستخدم بلا مساءلة.

من يتحكم في الطبقة؟

سؤال الحوكمة أساسي.

من يملك قرار إضافة LoRA؟

من يراجعها؟

من يحدد متى تُستخدم ومتى تُزال؟

لأن التحكم في طبقة صغيرة قد يعني التحكم في خطاب كامل.

التخصيص مقابل الانفتاح

LoRA تمثل ذروة فكرة التخصيص المرن.

لكن كل تخصيص هو في الوقت نفسه تضييق للاحتمالات الأخرى.

الذكاء الذي يُوجَّه دائمًا قد يفقد قدرته على المفاجأة، وعلى تقديم زوايا غير متوقعة.

السؤال ليس هل نخصص، بل إلى أي حد؟

LoRA كمرآة لفهمنا للنماذج

انتشار LoRA يكشف حقيقة مهمة:

النماذج اللغوية ليست كيانات صلبة، بل أنظمة مرنة شديدة الحساسية للتوجيه.

هذا يعيد طرح سؤال أعمق:

إذا كان تغيير صغير قادرًا على إعادة تشكيل السلوك، فإلى أي مدى نفهم فعلًا ما نقوم به؟

التوازن المطلوب

LoRA أداة ذكية، لكنها ليست بريئة.

هي تمنحنا قدرة كبيرة على التوجيه، مقابل مسؤولية أكبر في الاستخدام.

التوازن بين الكفاءة والشفافية، بين التخصيص والانفتاح، هو ما يحدد إن كانت LoRA إضافة صحية أم انحرافًا ناعمًا.

الخلاصة التحليلية

LoRA تُظهر أن الذكاء الاصطناعي لا يحتاج دائمًا إلى إعادة بناء ليُعاد توجيهه. أحيانًا، طبقة صغيرة تكفي لتغيير السلوك، والنبرة، وحدود الإجابة.

السؤال الحاسم لم يعد: ما حجم التعديل؟

بل: ما أثره على ما يُقال، وما لا يُقال؟

في عالم تتشكل فيه القرارات عبر نماذج لغوية، قد يكون أخطر تعديل هو ذلك الذي يبدو بسيطًا، لكنه يغيّر كل شيء من الداخل.

س: ما هي LoRA؟

ج: تقنية تخصيص تضيف طبقات صغيرة مدرَّبة إلى نموذج كبير دون تعديل أوزانه الأساسية.

س: ما ميزتها الأساسية؟

ج: سرعة التخصيص وانخفاض الكلفة مع الحفاظ على النموذج الأصلي.

س: كيف تغيّر السلوك؟

ج: عبر إعادة ترجيح الاحتمالات اللغوية دون تغيير المعرفة الأساسية.

س: هل هي أقل خطورة من Fine-tuning؟

ج: أقل تدميرًا للبنية، لكنها أكثر خفاءً في الأثر.

س: ما التحدي الأكبر؟

ج: استخدام LoRA دون شفافية أو مساءلة، رغم قدرتها على تغيير قرارات كبيرة عبر تعديل صغير.

اقرأ أيضًا: الذكاء الاصطناعي و”Benchmark Gaming”.. حين يتعلم النموذج اجتياز الاختبار لا فهم الواقع