AI بالعربي – متابعات

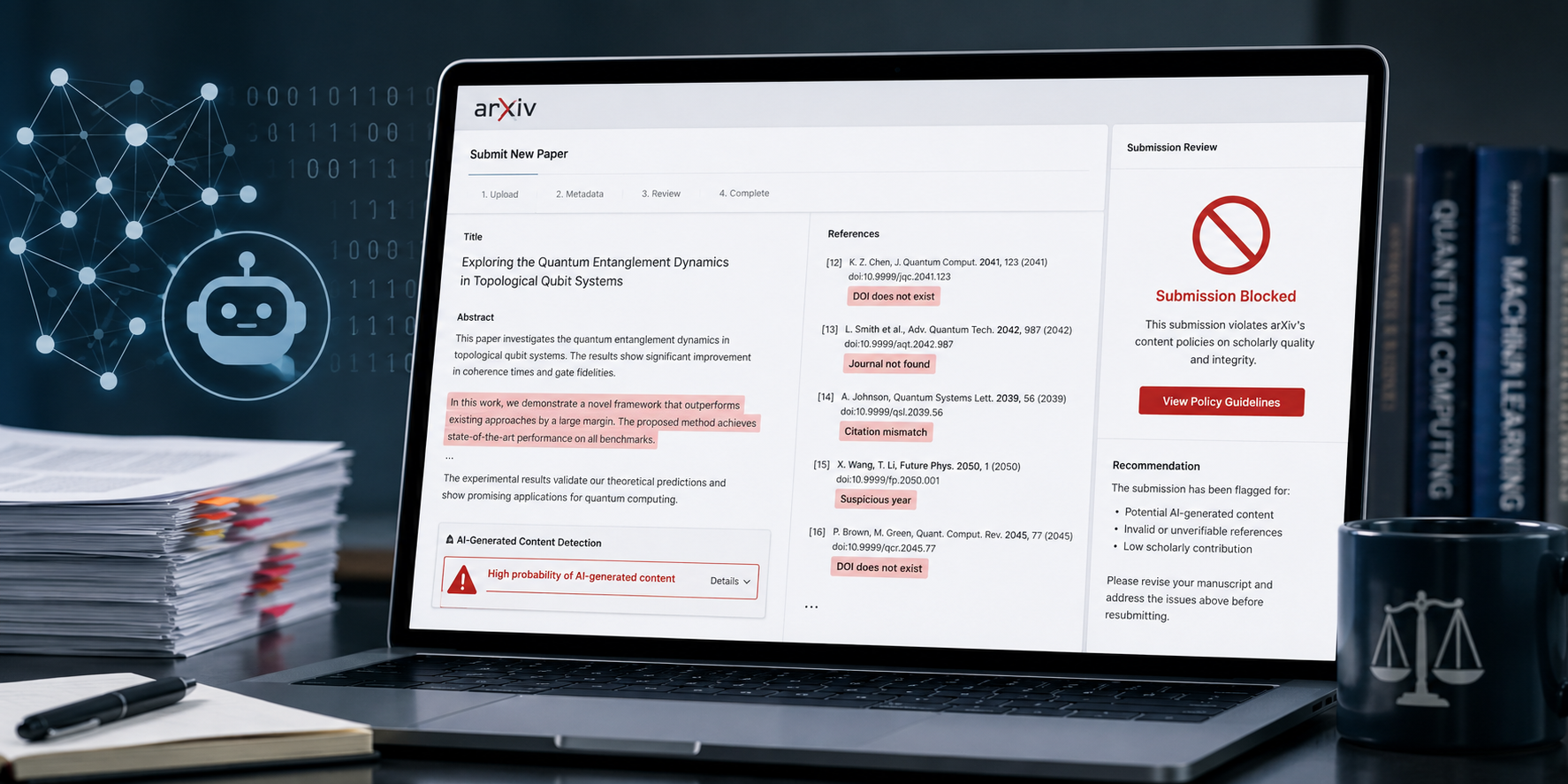

تتجه منصة “ArXiv”، إحدى أبرز منصات نشر الأبحاث الأكاديمية قبل المراجعة العلمية، إلى تشديد إجراءاتها ضد الأوراق البحثية منخفضة الجودة المنتجة بالذكاء الاصطناعي.

وتسعى المنصة إلى حماية جودة المحتوى العلمي، بعد تزايد المخاوف من انتشار أبحاث تتضمن مراجع وهمية أو عبارات مولدة آليًا دون مراجعة بشرية كافية.

حظر لمدة عام عند ثبوت المخالفة

أوضح توماس ديتريش، رئيس قسم علوم الحاسوب في “ArXiv”، أن المنصة قد تحظر بعض الباحثين لمدة عام كامل.

ويشمل القرار المؤلفين الذين يقدمون أبحاثًا تحتوي على أدلة واضحة تثبت عدم مراجعة مخرجات الذكاء الاصطناعي.

وتشمل هذه الأدلة وجود مراجع غير حقيقية، أو تعليقات وصفية تركها نموذج الذكاء الاصطناعي داخل النص البحثي.

شروط أكثر صرامة للنشر مستقبلاً

لن يتمكن الباحثون المحظورون من العودة مباشرة إلى النشر عبر المنصة بعد انتهاء العقوبة.

وستلزمهم “ArXiv” بتقديم أبحاث قُبلت أولًا لدى جهة نشر علمية محكمة وموثوقة.

ويهدف هذا الشرط إلى ضمان مرور الأبحاث بمراجعة علمية حقيقية قبل ظهورها مجددًا على المنصة.

آلية مراجعة قبل فرض العقوبة

أكد ديتريش أن السياسة الجديدة لن تطبق إلا في الحالات الواضحة.

وتبدأ الإجراءات بتوثيق المشكلة من جانب مشرف داخل المنصة.

وبعد ذلك، يراجع رئيس القسم الحالة ويؤكد المخالفة قبل فرض أي عقوبة.

كما تتيح “ArXiv” للمؤلفين حق الاستئناف على قرارات الحظر.

لماذا تشدد “ArXiv” قواعد الذكاء الاصطناعي؟

تأتي الخطوة بعد تزايد استخدام النماذج اللغوية الكبيرة في إنتاج النصوص البحثية.

وترى المنصة أن هذه الأدوات جعلت إنتاج محتوى طويل يبدو أكاديميًا أمرًا أسهل.

لكن المشكلة تظهر عندما يفتقر هذا المحتوى إلى التحقق العلمي أو المراجعة الدقيقة.

وتزداد الخطورة عند احتواء الورقة على مراجع وهمية أو نتائج غير مدققة.

سياسات سابقة ضد المحتوى الضعيف

كانت “ArXiv” قد حدثت سياساتها خلال العام الماضي لمواجهة المحتوى البحثي الرديء.

وركزت المنصة حينها على مقالات المراجعة وأوراق علوم الحاسوب.

واشترطت قبول هذه الأعمال في مؤتمر علمي أو دورية محكمة قبل نشرها عبر المنصة.

وقالت المنصة إن معظم أوراق المراجعة التي تصلها لا تقدم نقاشًا بحثيًا حقيقيًا.

وبدلًا من ذلك، تكتفي بعض الأوراق بقوائم مشروحة للمراجع دون تحليل عميق.

تأثير القرار على الباحثين

قد يدفع القرار الباحثين إلى مراجعة أبحاثهم بدقة أكبر قبل إرسالها.

كما يعزز مسؤولية المؤلفين عند استخدام أدوات الذكاء الاصطناعي في الكتابة أو التلخيص.

ولا تستهدف “ArXiv” منع استخدام الذكاء الاصطناعي بشكل كامل.

لكنها ترفض نشر محتوى غير مدقق يحمل أخطاءً واضحة أو مراجع مختلقة.

حماية جودة البحث العلمي

تعكس الخطوة اتجاهاً أوسع داخل المؤسسات الأكاديمية نحو ضبط استخدام الذكاء الاصطناعي.

فالأزمة لا ترتبط باستخدام التقنية نفسها، بل بطريقة التعامل مع نتائجها.

وتؤكد هذه السياسة أن المراجعة البشرية تظل عنصرًا أساسيًا في البحث العلمي.

كما تضع مسؤولية مباشرة على الباحثين قبل نشر أي ورقة عبر المنصات الأكاديمية.