AI بالعربي – متابعات

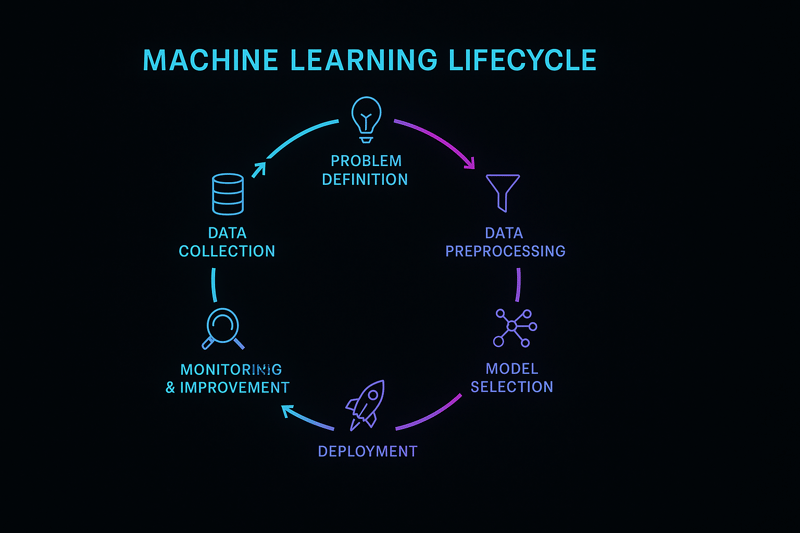

مع اتساع استخدام الذكاء الاصطناعي في القطاعات الحساسة، من الطب إلى المال إلى الإعلام، لم يعد السؤال فقط عن قوة النماذج، بل عن نظافة البيانات التي تتعلم منها. فالنموذج، مهما بلغ من التعقيد، يبقى انعكاسًا لما يتلقاه من بيانات. هنا يظهر مفهوم “Data Poisoning” أو تسميم البيانات، وهو أحد أخطر أنواع الهجمات على أنظمة التعلم الآلي. الفكرة بسيطة وخطيرة في آن واحد: بدل مهاجمة النظام بعد تشغيله، يُزرع الانحراف داخل بيانات التدريب نفسها، فيتعلم النموذج الخطأ على أنه حقيقة.

ما هو تسميم البيانات Data Poisoning؟

تسميم البيانات هو إدخال بيانات مضللة أو مصممة بعناية داخل مجموعة التدريب بهدف التأثير على سلوك النموذج لاحقًا. المهاجم لا يغيّر الخوارزمية، بل يغيّر ما تتعلمه. إذا تعلّم النموذج من بيانات منحرفة، فسوف يعكس هذا الانحراف في قراراته وتوقعاته.

لماذا يُعد تسميم البيانات خطيرًا؟

لأن أثره طويل الأمد. الخطأ لا يظهر كعطل مفاجئ، بل كسلوك “طبيعي” للنموذج. النموذج يظن أنه يعمل بشكل صحيح، لأنه يتبع ما تعلمه. هذا يجعل اكتشاف المشكلة أصعب بكثير من الهجمات المباشرة.

من أين تأتي بيانات التدريب؟

البيانات قد تأتي من الإنترنت، أو من مساهمات المستخدمين، أو من قواعد بيانات مؤسسية. كلما كان المصدر مفتوحًا أو ضخمًا، زادت صعوبة التحقق الكامل. هذا يخلق سطحًا واسعًا للهجوم.

كيف يُزرع الانحراف قبل التدريب؟

قد يقوم مهاجم بإدخال بيانات خاطئة ضمن مستودعات عامة. مثل مراجعات مزيفة، أو معلومات علمية غير دقيقة، أو تصنيفات خاطئة للصور. عندما تُجمع البيانات للتدريب، تختلط هذه العناصر بالبيانات السليمة.

الهجوم البطيء غير الملحوظ

كثير من هجمات التسميم لا تكون كبيرة وواضحة. يكفي تغيير نسبة صغيرة من البيانات للتأثير على النموذج. التعديل الطفيف قد يمر دون ملاحظة، لكنه يوجّه النموذج تدريجيًا.

التسميم الموجّه Targeted Poisoning

في هذا النوع، لا يحاول المهاجم إفساد النموذج بالكامل، بل دفعه لخطأ محدد. مثل جعل النموذج يخطئ في التعرف على فئة معينة، أو يفضّل نوعًا معينًا من النتائج. هذا أخطر لأنه دقيق.

التسميم العشوائي

هنا الهدف إضعاف الأداء العام. تُضاف بيانات ضجيجية أو خاطئة بشكل واسع. النتيجة نموذج أقل دقة وثباتًا.

البيانات المُعلَّمة خطأً

في التعلم الخاضع للإشراف، تعتمد النماذج على تسميات بشرية. إذا كانت هذه التسميات خاطئة عمدًا أو نتيجة إهمال، يتعلم النموذج روابط غير صحيحة. التسمية الخاطئة أداة فعالة للتسميم.

الاعتماد على البيانات المفتوحة

النماذج الكبيرة غالبًا تتدرّب على بيانات مفتوحة من الويب. هذا يمنح تنوعًا، لكنه يفتح الباب لمحتوى مضلل أو موجّه. الإنترنت ليس بيئة نقية معرفيًا.

تأثير التسميم على العدالة والانحياز

تسميم البيانات قد يعزز تحيزات أو يخلقها. إذا زُرعت بيانات تربط صفات سلبية بفئة معينة، قد يعكس النموذج هذا الربط. هنا يتحول الهجوم التقني إلى أثر اجتماعي.

التسميم في أنظمة التوصية

أنظمة التوصية تعتمد على سلوك المستخدمين. حسابات مزيفة أو تفاعلات مصطنعة قد تغيّر ما يوصي به النظام. هذا شكل من تسميم البيانات السلوكية.

هل كل خطأ في البيانات يُعد هجومًا؟

لا. هناك فرق بين الضجيج الطبيعي والهجوم المتعمد. البيانات الواقعية دائمًا تحتوي أخطاء. التسميم يتضمن نية وتأثيرًا موجّهًا.

لماذا يصعب اكتشاف التسميم؟

لأن البيانات ضخمة. مراجعة كل عنصر يدويًا غير ممكنة. كما أن الهجوم قد يكون ذكيًا ومتخفيًا داخل بيانات تبدو طبيعية.

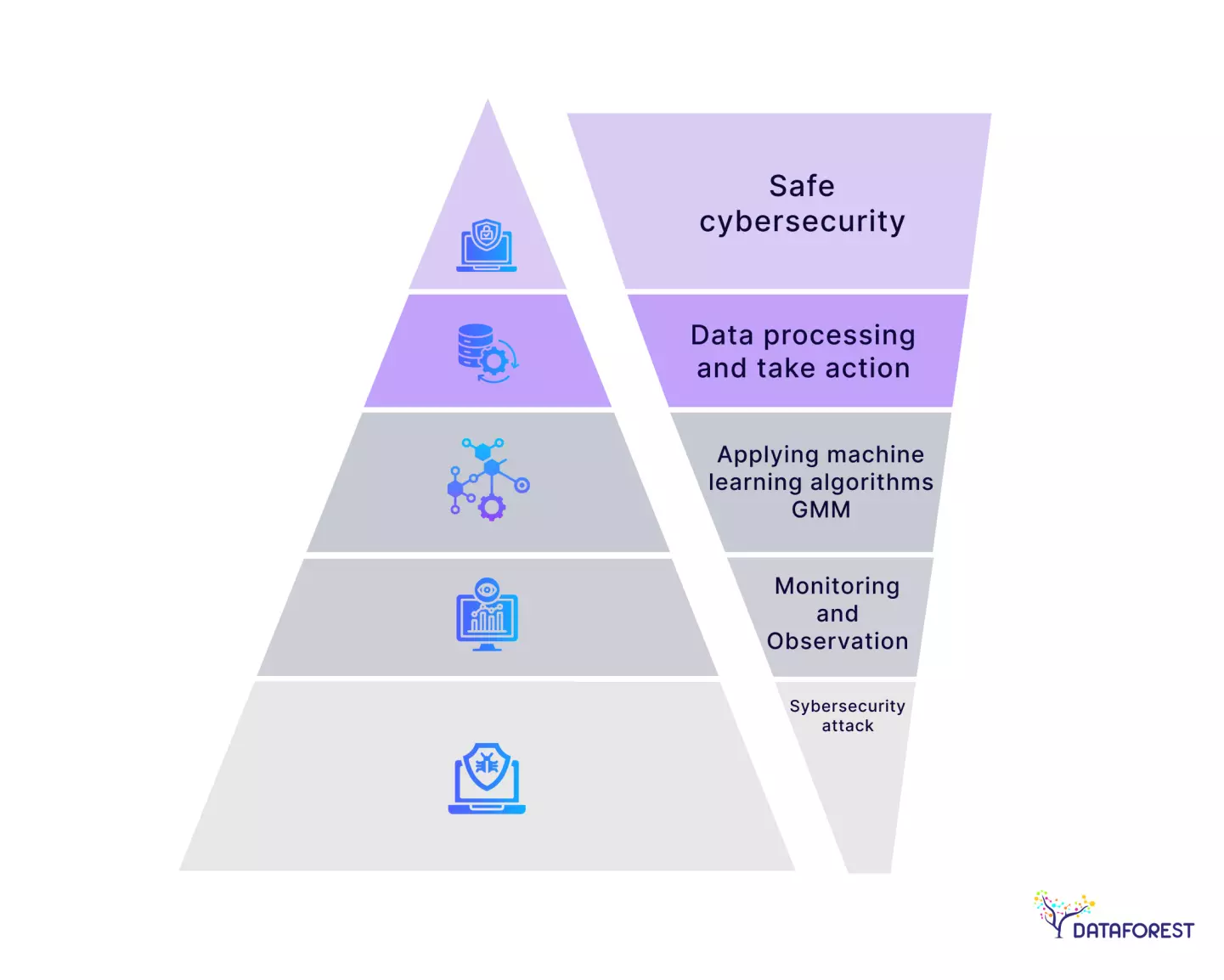

آليات الدفاع الأساسية

أول خط دفاع هو جودة جمع البيانات. اختيار مصادر موثوقة، وتنويعها، وتقييمها. كلما كانت خطوط الإمداد أوضح، كان التحكم أفضل.

التنقية المسبقة للبيانات

تُستخدم تقنيات لاكتشاف القيم الشاذة والأنماط غير الطبيعية. هذه لا تمنع كل الهجمات لكنها تقلل المخاطر.

التدريب المقاوم للتسميم

بعض الأساليب تجعل النماذج أقل تأثرًا بالبيانات الشاذة. مثل إعطاء وزن أقل للعينات غير المتسقة. هذا يزيد الصلابة.

التحقق بعد التدريب

اختبار النموذج على مجموعات تحقق مستقلة قد يكشف سلوكًا غير متوقع. إذا ظهرت أنماط غريبة، قد يكون السبب تسميمًا.

دور الشفافية

توثيق مصادر البيانات وخطوات جمعها يساعد في المراجعة. الشفافية لا تمنع الهجوم لكنها تسهّل اكتشافه.

الإنسان في الحلقة

في التطبيقات الحساسة، يبقى التقييم البشري مهمًا. البشر قد يلاحظون انحرافات لا تلتقطها الخوارزميات بسهولة.

التحدي في النماذج الضخمة

كلما كبر النموذج، زادت كمية البيانات المطلوبة. هذا يوسّع سطح الهجوم. إدارة البيانات تصبح مشروعًا بحد ذاته.

الأثر طويل المدى

النموذج المسموم قد يُستخدم كأساس لنماذج أخرى. الانحراف قد ينتقل عبر الأجيال. هذا يجعل المشكلة تراكمية.

هل يعني هذا أن التدريب على بيانات ضخمة خطر؟

ليس بالضرورة. الحجم يمنح قوة، لكنه يتطلب حوكمة قوية. المسألة في الإدارة لا في المبدأ.

اتجاهات مستقبلية للحماية

نرى اهتمامًا متزايدًا بأمن البيانات في الذكاء الاصطناعي. أدوات كشف التسميم، وتوثيق مصادر البيانات، وأنظمة التتبع ستصبح أكثر شيوعًا.

الثقة الواقعية بدل المثالية

لا توجد بيانات نقية بالكامل. الهدف تقليل المخاطر لا إلغاؤها. الثقة يجب أن تكون مبنية على فهم الحدود.

الصورة الكبرى

تسميم البيانات يذكّرنا أن الذكاء الاصطناعي يتعلّم من عالم غير مثالي. حماية النماذج تبدأ بحماية بياناتها. الجودة ليست ترفًا بل أساس.

خلاصة المشهد

Data Poisoning يكشف أن أخطر الهجمات قد تبدأ قبل تشغيل النموذج بوقت طويل. حين يُزرع الانحراف في البيانات، يتعلمه النظام كأنه حقيقة. الدفاع لا يعتمد فقط على خوارزميات أذكى، بل على إدارة بيانات واعية، وتحقق مستمر، وحوكمة واضحة. في النهاية، الذكاء الاصطناعي بقدر ما نعلّمه، لا أكثر ولا أقل.

ما هو Data Poisoning؟

إدخال بيانات مضللة في التدريب للتأثير على سلوك النموذج.

هل يؤثر على كل النماذج؟

يمكن أن يؤثر على أي نموذج يعتمد على بيانات تدريب.

كيف يحدث غالبًا؟

عبر مصادر بيانات مفتوحة أو تسميات خاطئة.

كيف نحد منه؟

بمراجعة المصادر وتنقية البيانات واختبارات التحقق.

الفكرة الأساسية؟

جودة النموذج من جودة بياناته.

اقرأ أيضًا: الذكاء الاصطناعي و”Google AI Mode”.. لماذا تغيّر البحث المحادثي قواعد الظهور في النتائج؟