AI بالعربي – متابعات

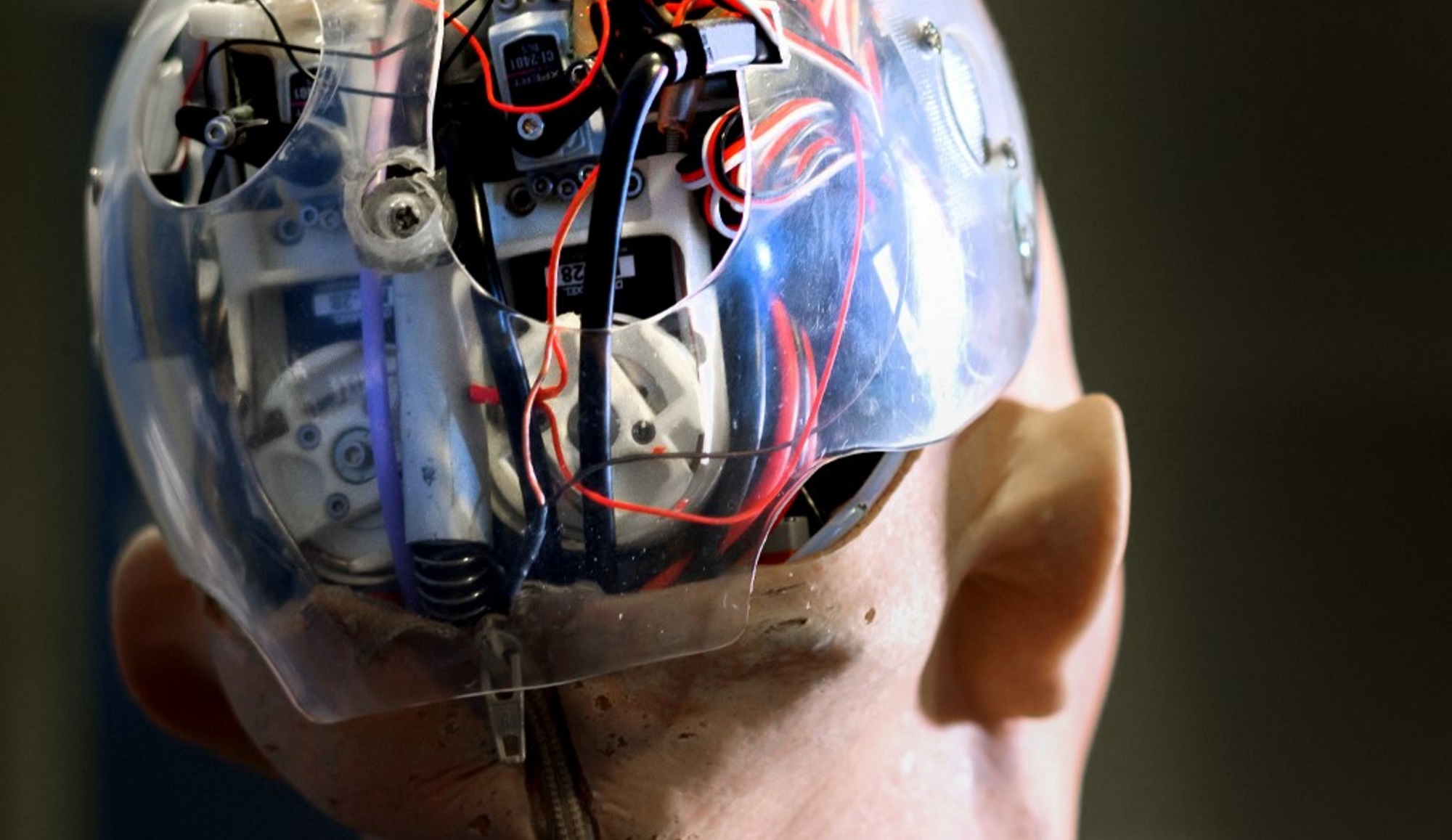

يثير الذكاء الاصطناعي مخاوف دولية دفعت قادة دول مجموعة السبع إلى طرح الملف في قمتهم التي بدأت أعمالها، الجمعة، في اليابان، حيث يناقش الزعماء خيارات معقدة لضبط هذه التكنولوجيا المتقدمة التي يتوقع علماء أن تحدث تغييرا في المجتمعات البشرية، وتشكل تحديا لأمن الدول، وفقًا لما نشره موقع الحرة.

وخلال الاشهر الماضية أثارت مخاطر الذكاء الاصطناعي التوليدي القادر على ابتكار نصوص أو صور وفيديوهات اهتمام العديد من الدول وحتى العاملين في قطاع التكنولوجيا الذين تحدثوا عن حاجة ملحة “لتنظيم عالمي” لهذا القطاع.

ورغم حديث بعض الدول والهيئات التنظيمية عن توجهها لتنظيم الذكاء الاصطناعي إلا أن تطور هذه التكنولوجيا يتجاوز الجميع خاصة في ظل التسابق المحموم بين عمالقة التقنية.

وحذر تقرير نشرته مجلة ناشونال إنترست من عدم إيلاء “تنظيم الذكاء الاصطناعي” الأولوية على أجندة قادة مجموعة السبع، معتبرا أن حصول ذلك قد يعني “فرصة ضائعة لمعالجة الابتكار السريع في هذا المجال الذي ستكون له آثار اجتماعية حتمية”.

وأشار إلى أن العلاقات بين الولايات المتحدة والصين، وتعزيز التعاون في منطقة المحيط الهادئ، والصراع أوكرانيا قد تسرق الأضواء في القمة، ولكن على زعماء هذه الدول الاتفاق في تطوير “اتفاقية أو معاهدة تحظر تطوير أنظمة الذكاء الاصطناعي الخطيرة” ووضع معايير تنظيمية تضمن المنافسة بين الشركات وعدم كبت الابتكار، ولكن أن تبقيها في إطار تعظيم الفوائد للبشرية.

وأفاد التقرير بأنه إذا لم يفعل زعماء مجموعة السبع ذلك “يمكن للبشرية أن تجني عواقب” وخيمة، إذ من المهم التحكم في طرح “نماذج الذكاء الاصطناعي المتقدمة، بما يسمح للمشرعين” التصدي لأية مفاجآت، مشيرا إلى أننا قد نشهد سباقا في تطوير هذه التقنية بين الولايات المتحدة والصين.

حاجة ماسة

أستاذ الذكاء الاصطناعي، أشرف النجار، يرى إن هناك “حاجة ماسة لسياسة عالمية موحدة لتنظيم الذكاء الاصطناعي لضمان استخدام آمن ومسؤول لهذه التقنية الجديدة”، مشيرا إلى أن هذه التقنية ليست محدودة “بحدود جغرافية وتطبيقاتها وتأثيراتها يمكن أن تصل إلى كافة جميع الدول”.

ويعتقد النجار في حديثه لموقع “الحرة” أن “التأطير العالمي للذكاء الاصطناعي سيسهم بلا شك، في توحيد المعايير والقواعد التي تحكم استخدام تقنياته مما سيساعد على الحد من الاستخدامات الضارة أو غير الأخلاقية”.

الخبير الاقتصادي المتخصص في قطاع الاتصالات وتكنولوجيا المعلومات، وصفي الصفدي، قال إن العالم في حالة “ذعر من هذا الأمر، ورغم ظهور العديد من التقنيات خلال السنوات الماضية، إلا أن الذكاء الاصطناعي أثار اهتماما يشابه التعامل مع ملف التسلح النووي الدولي، فالجميع يريد وضع خطوط حمراء حتى لا يتجاوزها المطورون”.

ويؤكد في رده على استفسارات موقع “الحرة” أن هناك مخاوف “من أنظمة الذكاء الاصطناعي المتطورة وأثرها بشكل عام، فيما يحذر البعض أيضا من إمكانية تطوير هذه الأنظمة لنفسها، وكأنه يصبح لها عقل منفصل لا يمكن التحكم به من قبل البشر، في محاكاة تشبه ما نراه في أفلام الخيال العلمي”.

وبعيدا عن تطوير الذكاء الاصطناعي لنفسه إلا أن قدراته الحالية هائلة ومتطورة والتي إذا ما استخدمت في “الجانب المظلم” قد تكون “نتائجها كارثية”، ولهذا على قادة مجموعة الدول السبع، وحتى بقية الدول وضع “سياسة عامة عالمية موحدة لتنظيم الذكاء الاصطناعي” لتعظيم فوائده وتقليل سلبياته، وفق الصفدي.

وشدد الرئيس التنفيذي لشركة “أوبن إيه آي”، سام ألتمان، أمام مجلس الشيوخ الأميركي، الثلاثاء، على ضرورة وضع أطر تنظيمية للذكاء الاصطناعي.

وحض خلال جلسة استماع عن تأثير الذكاء الاصطناعي، الكونغرس على فرض قواعد جديدة على شركات التكنولوجيا الكبرى، على الرغم من انقسامات سياسية حادة تعوق منذ سنوات تشريعا يرمي إلى تنظيم قطاع الإنترنت.

وقال ألتمان “نعتقد أن التدخل التنظيمي من قبل الحكومات سيكون ضروريا للتخفيف من مخاطر النماذج التي تزداد قوة”، مشيرا إلى تحديات على غرار التضليل وإلغاء الوظائف.

وأثارت برمجية “تشات جي بي تي” اهتماما واسعا في العالم بالذكاء الاصطناعي التوليدي، لكن نشر صور زائفة على مواقع التواصل الاجتماعي، أكثر واقعية من الصور الحقيقية، والتي تم إنشاؤها من تطبيقات مثل ميدجورني (Midjourney)، نبهت إلى مخاطر التلاعب بالرأي العام.

وتابع ألتمان أنه “تم تأسيس أوبن إيه آي” بناء على اعتقاد بأن الذكاء الاصطناعي لديه القدرة على تحسين كل جانب من جوانب حياتنا تقريبا، ولكنه أيضا يخلق مخاطر جسيمة”.

لكن ألتمان شدد على أن الذكاء الاصطناعي الذي تطوره “أوبن إيه آي” سيكون قادرا على معالجة “بعض من أكبر التحديات التي تواجه البشرية على غرار التغير المناخي وشفاء مرضى السرطان”.

تحديات عالمية

ويوضح الأكاديمي النجار أن التنظيم العالمي للذكاء الاصطناعي سيواجه العديد من التحديات خاصة “في تنفيذ سياسة عالمية، في ظل وجود اختلافات في القوانين والثقافات بين الدول المختلفة، ناهيك عن القضايا المتعلقة بالسيادة والتنافس الدولي”.

وتابع أن “البدء بالحوار الدولي حول الذكاء الاصطناعي، والعمل على تطوير إطار تنظيمي عالمي يحترم القيم والحقوق الإنسانية بطرق تحافظ على الأمن والاستقرار والعدالة على مستوى العالم، ضرورة ماسة، وهو ما يتطلب العمل المشترك والتعاون الدولي لوضع قوانين ومعايير مشتركة قابلة للتطبيق في الدول المختلفة لضمان أن يكون التطبيق متسقا وعادلا”.

ويشير النجار إلى أن أي إطار قانوني عليه تحديد “الاستخدامات المقبولة للذكاء الاصطناعي، وتحديد المسؤولية في حالة الضرر أو الإساءة، ما أهمية بذل جهود في التوعية العامة والتثقيف لضمان الوصول لاستخدام آمن ومسؤول لتطبيقات الذكاء الاصطناعي المختلفة”.

ويطالب عمالقة التكنولوجيا الأميركيون بتأطير استخدامه فيما يعلن عن خدمات جديدة للذكاء الاصطناعي كل أسبوع. ودعت، كريستينا مونتغمري، نائبة رئيس شركة “آي بي أم” للثقة والخصوصية إلى تنظيم القطاع من دون أن يعوق ذلك الابتكار.

وفي أبريل، قال رئيس غوغل، سوندار بيتشاي، إنه “على المدى الطويل سيكون من الضروري تطوير لائحة تنظيمية عالمية” ولكن “ما زلنا في البداية”.

في نهاية مارس، طالبت أكثر من ألف شخصية بأن يتم ولمدة ستة أشهر وقف الأبحاث على الذكاء الاصطناعي من بينهم إيلون ماسك الذي يعمل أيضًا على تطوير شركة للذكاء الاصطناعي والمفكر يوفال نوا هراري المقتنع بأن الذكاء الاصطناعي يمكن أن يدمر البشرية، بحسب تقرير لوكالة فرانس برس.

وقال الناشط، تريستان هاريس، كبير مسؤولي الأخلاقيات السابق في غوغل، “لا نريد عالما تضع فيه خمس شركات الإنسانية على متن طائرة الذكاء الاصطناعي من دون التفكير في المستقبل الذي نريده”.

أطر التنظيم

خبير التكنولوجيا المتخصص بالروبوتات والذكاء الاصطناعي، سامر المبيض، قال إنه سيكون من الصعوبة “الوصول إلى توافقات في الاستراتيجيات بين الدول المختلفة فيما يتعلق بالذكاء الاصطناعي، ورغم الحديث عن الحاجة لتنظيمه إلا أن هناك سباقا عالميا يجري حاليا يسعى فيه الجميع لاكتساب ميزة تنافسية وحتى احتكار للتكنولوجيا”.

ويشرح المبيض، وهو رئيس تنفيذي لشركة “فرهات روبوتيكس” المتخصصة في تصنيع روبوتات تعمل بالذكاء الاصطناعي لموقع “الحرة” أن “الدول التي ستتبنى أنظمة الذكاء الاصطناعي ستشهد تقدما خلال الفترة المقبلة أسرع من بقية الدول، وهذا قد يخلق نوعا من الفجوة بين الدول المتقدمة ذاتها وبين الدول التي لا تمتلك هذه التكنولوجيا”.

وحدد ثلاثة أمور مرتبطة بالذكاء الاصطناعي، وتحتاج إلى تنظيم على مستوى عالمي، والتي تضم:

إتاحة التقنية للجميع

يجب ضمان وجود منصات ومؤسسات دولية تسهل الوصول الميسر لتكنولوجيا الذكاء الاصطناعي لجميع الدول، وتعظيم فوائدها في الدول النامية وليس في الدول المتقدمة خاصة في مجالات التعليم والرعاية الصحية.

إتاحة الحقيقة للجميع

يجب توفير أدوات عالمية يتعاون فيها المطورين للذكاء الاصطناعي مع الدول أو المؤسسات الدولية من أجل ضمان التمييز بين ما هو “حقيقي وما هو من صنع الذكاء الاصطناعي”، من خلال الحد من انتشار الأخبار غير الصحيحة والمعلومات المضللة.

ضمانات للملكية الفكرية

إنشاء معيار عالمي لتحديد حقوق الملكية الفكرية، وتمييز تلك الأفكار التي يطورها البشر عن تلك التي تولدها أنظمة الذكاء الاصطناعي التوليدي خاصة مع القدرات التي توفرها التطبيقات بإنشاء تصميمات وأنظمة جديدة للمشاكل التقنية.

في أوروبا، يدق ناقوس الخطر قبل كل شيء الباحثون والخبراء وواضعو الأنظمة، وقد تضاعفت في الأسابيع الأخيرة الخطابات المناهضة للذكاء الاصطناعي.

في غضون ذلك، يحرز الاتحاد الأوروبي تقدما بشأن “قانون الذكاء الاصطناعي” الخاص به. في الأسبوع الماضي، وافق البرلمان الأوروبي على إطار عمل يجب التصويت عليه في يونيو. لكن الأمر سيستغرق سنوات قبل وضعه موضع التنفيذ.

سيفرض النص على أنظمة الذكاء الاصطناعي التوليدية مثل “تشات جي بي تي” الحصول على إذن مسبق وشفافية الخوارزميات والبيانات الخاصة بها.

من دون تحديد الأسباب، أعلنت غوغل هذا الأسبوع عن نشر برمجية بارد المنافسة لتشات جي بي تي في 180 دولة. ولكن ليس في الاتحاد الأوروبي.

الجميع يحذر والتطوير مستمر

الذكاء الاصطناعي لا يثير مخاوف المستخدمين والدول فقط إذ أن قادة الشركات عمالقة التكنولوجيا أصبحوا يتخوفون أيضا من تطبيقاته، بحسب ما أكد خبير في الأمن السيبراني والتحول الرقمي، رولان أبي نجم، لموقع “الحرة”.

وبين أن الجميع “يحذر ولكن الشركات ماضية في تطوير أنظمة الذكاء الاصطناعي وتنافس لتتفوق بها”، مشيرا إلى أن بعض التطبيقات أصبح لديها القدرة على “التفكير أو التخطيط بطريقة تشابه الإنسان في اتخاذ القرارات بناء على اعتبارات أكثر منطقية”.

وأوضح أبي نجم “أن قادة الدول في مجموعة السبع وحتى بقية الدول حول العالم، عليهم الوصول إلى صيغة اتفاقية دولية تنظم المبادئ العامة للتعامل مع الذكاء الاصطناعي، والتي ستحدد نطاق العمل للشركات بما يضمن تقليل الاستخدام الخاطئ لهذه التقنية”.

وذكر أن الجميع “بانتظار مثل هذه الاتفاقية الدولية، ولكن يبقى الاعتماد الأكبر على آليات تطبيقها وتنفيذها”، ومنوها إلى وجود “اختلافات وفروقات في تعامل الدول حاليا مع هذا الملف حيث يوجد اختلافات بين المبادئ العامة التي تتحدث فيها الدول الأوروبية والولايات المتحدة، مقارنة مع ما يتم الحديث عنه في الصين أو روسيا”.

وقال أبي نجم “منذ ظهور الإنترنت والمواقع الإلكترونية وشبكات التواصل الاجتماعي وحتى الآن، لم يستطع العالم للوصول إلى سياسة موحدة للتعامل مع هذه التطورات، فهل ستتمكن الدول من وضع سياسة عامة عالمية للذكاء الاصطناعي؟”.

وفي مطلع مايو نبه البيت الأبيض الرؤساء التنفيذيين لشركات التكنولوجيا الأميركية العملاقة إلى مسؤوليتهم “الأخلاقية” لحماية المستخدمين من المخاطر الاجتماعية المحتملة للذكاء الاصطناعي.

وكانت، كامالا هاريس، نائبة الرئيس الأميركي قد دعت رؤساء شركات غوغل ومايكروسوف و”أوبن إيه آي” وأنثروبيكا لاجتماع في وقت لا يزال تنظيم الذكاء الاصطناعي البالغ الأهمية يقع على عاتق الشركات نفسها.

ونقلت هاريس إليهم قلق إدارة الرئيس، جو بايدن، من تسابق هذه الشركات نحو تطوير تكنولوجيا قد تؤدي الى أضرار خطرة على المجتمع.

وقالت هاريس في بيان: “كما تشاركت مع الرؤساء التنفيذيين لشركات هي في طليعة الابتكار الأميركي في مجال الذكاء الاصطناعي، للقطاع الخاص مسؤولية أخلاقية ومعنوية وقانونية لضمان سلامة وأمن منتجاتهم”.

وأشارت إلى أن الذكاء الاصطناعي قادر “على تحسين حياة الناس والتصدي لكبرى التحديات التي يواجهها المجتمع”، لكنه قادر أيضا “في الوقت عينه … على أن يزيد بشكل هائل المخاطر حيال الأمن والسلامة، وينتهك الحقوق المدنية والخصوصية، ويقوض ثقة الجمهور وإيمانه بالديمقراطية”.

وشددت على وجوب أن “تمتثل الشركات للقوانين القائمة لحماية الشعب الأميركي” إضافة لضمان أمن منتجاتها.

وسبق لبايدن أن حض الكونغرس على إقرار قوانين تضع قيودا أكثر صرامة على قطاع التكنولوجيا، الا أنه يستبعد أن تمضي هذه الجهود بعيدا في ظل الانقسام السياسي في الولايات المتحدة.

وحض البيت الأبيض على خطوات جديدة “للترويج لابتكار أميركي مسؤول في الذكاء الاصطناعي”، ويشمل ذلك تخصيص 140 مليون دولار لتوسيع البحث بشأن الذكاء الاصطناعي ووضع نظام تقييم للعمل مع الشركات الكبرى من أجل “تصحيح” بعض الأمور المثيرة للجدل بشأن الذكاء الاصطناعي.